Die Unternehmen bündeln ihre Expertise, um Kunden intelligente, automatisierte und kontextreiche Lösungen zu bieten und Wachstumspotenziale auszubauen.

Stuttgart und Wiesbaden, 03. November 2025 – Theobald Software, der Experte für nahtlose SAP-Integration, gibt heute die Übernahme der bluetelligence GmbH („bluetelligence“) bekannt, einem Softwareunternehmen im Bereich SAP-Metadatenmanagement. Durch den Zusammenschluss bündeln die beiden Unternehmen ihre SAP-Kompetenz und erweitern ihr Portfolio um Funktionen für Metadaten-Management und Datenintelligenz – für mehr Effizienz, Genauigkeit und tiefere Einblicke in SAP-Systeme.

„Der Zusammenschluss von Theobald Software und bluetelligence ist ein großer Schritt, um unseren Kunden eine noch umfassendere Datentransparenz zu bieten“, sagt Dr. Thomas Bruggner, CEO von Theobald Software. „Die Technologie von bluetelligence ergänzt unsere Lösungen optimal. Durch die neue Dimension der Metadaten können unsere Kunden SAP-Daten künftig noch besser nutzen, intelligent automatisieren, dokumentieren und analysieren. Damit schaffen wir echten Mehrwert für Unternehmen – gerade mit Blick auf die wachsenden Anforderungen durch Künstliche Intelligenz.“

Auch Torsten Schmidt, Gründer und bisheriger CEO von bluetelligence, sieht in der Vereinigung die logische Weiterentwicklung: „Unsere Expertise in SAP-Metadaten-Management ergänzt die nahtlose SAP-Integration von Theobald Software um eine entscheidende Komponente. Für mich stand seit jeher die bestmögliche Kundenerfahrung in SAP-Umgebungen im Fokus – die Symbiose unserer Softwareprodukte macht genau das möglich. Unternehmen profitieren von einem ganzheitlichen Portfolio und noch tieferen Einblicken auf Basis entscheidungsrelevanter Daten.“ Der bisherige CEO und Gründer bleibt auch künftig in aktiver und beratender Funktion an Bord.

Gemeinsamer Blick in die Zukunft

Theobald Software und bluetelligence verfolgen eine gemeinsame Vision: Sie wollen ihre Technologien konsequent weiterentwickeln, um Unternehmen bei den Herausforderungen der digitalen Transformation im SAP-Umfeld bestmöglich zu unterstützen. Im Zentrum steht dabei die optimale Verfügbarkeit und Nutzbarkeit von Daten – als Grundlage für datengetriebene Entscheidungen und den erfolgreichen Einsatz von Künstlicher Intelligenz. Durch die Bündelung ihrer Expertise schaffen beide Unternehmen die Basis für nachhaltiges Wachstum und sichern ihre Technologieführerschaft im SAP-Umfeld. Kunden profitieren von praxisnahen, innovativen Lösungen, die Transparenz, Effizienz und Datenintelligenz messbar steigern.

Über Theobald Software

Theobald Software, 2004 in Stuttgart gegründet, ist ein weltweit führender Experte für nahtlose SAP-Integration. Die Lösungen von Theobald ermöglichen die Nutzung von SAP-Daten in nahezu jedem Drittsystem – sei es On-Premises oder in der Cloud. Weltweit vertrauen über 1.700 aktive Kunden aller Branchen und Größen auf die Expertise der Stuttgarter, um ihre SAP-Daten effizient und strategisch zu nutzen. Von Niederlassungen in Europa und den USA aus betreuen rund 60 hochqualifizierte Fachkräfte zahlreiche Großunternehmen und Mittelständler sowie in Deutschland eine große Mehrheit der DAX-Unternehmen. Gemeinsam mit starken Partnern wie SAP & Microsoft und weiteren globalen Unternehmen behält Theobald Software stets die Entwicklung optimaler Lösungen im Blick.

Über bluetelligence

bluetelligence entwickelt seit 17 Jahren marktführende Software für die Dokumentation, Analyse, Migration, Übersetzung und Katalogisierung von SAP-Metadaten. Nach dem Motto „Work smarter, not harder“ erleichtern die automatisierten Lösungen mittlerweile über 200 Kunden im europäischen Raum den Arbeitsalltag im Business Intelligence.

Pressekontakt Theobald Software GmbH

Benjamin Föll

Head of Global Marketing & Communications

E-Mail: benjamin.foell@theobald-software.com

Pressekontakt bluetelligence GmbH

Charlotte Fiox

Marketing Manager

E-Mail: charlotte.fiox@bluetelligence.de

Pressekontakt Maisberger GmbH

Anja Söldner / Susanne Leisten

E-Mail: theobald-software@maisberger.com

In der heutigen datengetriebenen Welt ist eine effektive Datenkatalogisierung essenziell, um Daten effizient zu verwalten, zu verstehen und optimal zu nutzen. Und insbesondere in Unternehmen mit komplexen SAP-Landschaften wird Data Cataloging immer wichtiger, um Datenqualität zu sichern, regulatorische Anforderungen zu erfüllen und datengetriebene Entscheidungen zu erleichtern. Dieser Artikel vergleicht die drei wesentlichen Optionen, die SAP-zentrierte BIler haben: Den Datasphere Catalog von SAP, die Collibra Data Intelligence Cloud und das Enterprise Glossary von bluetelligence.

Warum Data Cataloging im SAP-Umfeld wichtig ist:

SAP-Systeme sind das Rückgrat vieler Unternehmen und enthalten eine enorme Menge an geschäftskritischen Daten. Ohne eine strukturierte Datenkatalogisierung entstehen häufig folgende Herausforderungen:

Datenfindung: Wo befinden sich die benötigten Daten?

Datenverständnis: Was bedeuten die Datenfelder und wie hängen sie zusammen?

Datenqualität: Sind die Daten zuverlässig und aktuell?

Compliance: Werden regulatorische Anforderungen erfüllt?

Ein Data Cataloging Tool hilft, diese Probleme zu lösen, indem es eine zentrale Übersicht aller relevanten Datenressourcen bietet und Kontextinformationen bereitstellt. Dies erleichtert die Zusammenarbeit zwischen Fachanwendern, IT-Teams und Datenexperten erheblich.

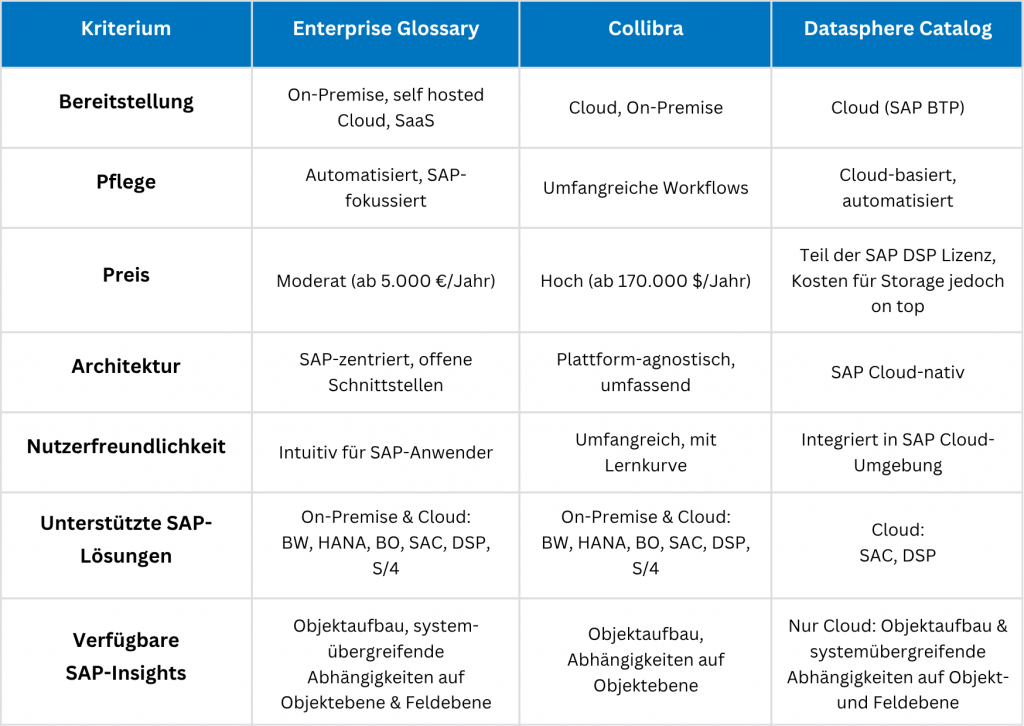

Drei prominente Cataloging Tools für eine vor allem SAP-dominierten BI sind das Enterprise Glossary, Collibra Data Intelligence Cloud und der Datasphere Catalog. In diesem Artikel stellen wir die Lösungen gegenüber – in Kategorien wie Preis, Einrichtung, Pflege, Bereitstellung und Funktionsumfang. Auch wenn wir selbst Anbieter des Enterprise Glossary sind, haben wir uns um eine neutrale Beobachtung bemüht – wer sich zusätzlich noch anderweitig informieren möchte, findet hier einen weiteren Vergleich des Beratungshauses infomotion.

Die Kandidaten im Überblick: DSP, Collibra und Enterprise Glossary

Enterprise Glossary (bluetelligence)

Das Enterprise Glossary ist eine spezialisierte Lösung für SAP-Umgebungen, die ein umfassendes semantisches Glossar bereitstellt. Es verbindet Fachbegriffe mit technischen Metadaten aus SAP-Systemen und zeichnet sich durch seine einfache Bedienbarkeit sowie direkte Integration in die SAP-Welt aus.

Collibra Data Intelligence Cloud

Collibra ist eine führende Enterprise-Data-Intelligence-Plattform mit umfassenden Funktionen für Data Governance, Data Quality und Data Cataloging. Die Lösung richtet sich an Unternehmen mit komplexen, heterogenen Datenlandschaften und bietet eine breite Skalierbarkeit.

Datasphere Catalog (SAP)

Der Datasphere Catalog ist in die SAP Datasphere (ehemals Data Warehouse Cloud) integriert und dient primär der Verwaltung und Strukturierung von Daten in der SAP-Cloud-Umgebung. Besonders für Unternehmen, die bereits stark auf SAP Cloud-Lösungen setzen, ist dieser Ansatz interessant.

Detaillierter Vergleich der Data Catalogs

1. Preis

Das Enterprise Glossary bietet ein attraktives Preis-Leistungs-Verhältnis ab 5.000 € pro Jahr, inklusive einer unbegrenzten Anzahl lesender Benutzer. Collibra hingegen befindet sich mit Kosten ab 170.000 $ pro Jahr im Premium-Preissegment, was es eher für Konzerne attraktiv macht. Der Datasphere Catalog ist Teil der SAP Datasphere Lizenzierung, wodurch Unternehmen, die bereits SAP Cloud nutzen und somit auch auf das Tool Zugriff haben – je nach benötigtem Storage und Integration der Metadaten steigt die Lizenz jedoch im Preis.

2. Einrichtung

Das Enterprise Glossary lässt sich innerhalb von zwei Tagen implementieren und synchronisiert sich automatisch mit SAP-Systemen. Der Einsatz von Collibra erfordert eine umfassende Einrichtung, die mehr Zeit beansprucht und Schulungen erfordert. Der Datasphere Catalog ist in SAP Datasphere integriert und daher für bestehende SAP-Cloud-Kunden einfach zugänglich.

3. Pflege

Das Enterprise Glossary punktet mit einem automatisierten Glossar und vordefinierten Templates, die den Pflegeaufwand minimieren. Collibra bietet ebenfalls Automatisierung, aufgrund der Plattformkomplexität benötigen Benutzer jedoch mehr Aufwand für die Einarbeitung. Der Datasphere Catalog ist cloudbasiert und weitgehend automatisiert, jedoch funktional rein auf die SAP Cloud beschränkt.

4. Bereitstellung & Architektur

Das Enterprise Glossary ist flexibel und kann sowohl On-Premise als auch selber in der Cloud gehostet werden. Weiterhin bietet bluetelligence auch eine SaaS Version an. Collibra bietet ebenfalls On-Premise- und Cloud-Optionen, ist aber nicht SAP-zentriert. Der Datasphere Catalog ist ausschließlich als Cloud-Lösung in der SAP BTP verfügbar.

5. Nutzerfreundlichkeit & Komplexität

Das Enterprise Glossary ist für Business User und SAP-Anwender besonders intuitiv und bietet eine schnelle Lernkurve. Collibra bietet eine umfassendere Plattform, die jedoch erheblich mehr Einarbeitung erfordert. Der Datasphere Catalog ist für Unternehmen mit bestehenden SAP Cloud-Strukturen angenehm zu bedienen.

6. & 7. Unterstützte SAP-Lösungen und -Insights

Das Enterprise Glossary fokussiert sich auf SAP-spezifische Datenkatalogisierung und die Verwaltung von Metadaten – dieser Fokus spiegelt sich daher auch im höheren Informationsgehalt der Metadaten wieder. Collibra ist trotz der eingegangenen strategischen Partnerschaft mit SAP eine breit aufgestellte Data Governance-Plattform, die weit über SAP hinausgeht und daher auch in Puncto Detailtiefe der SAP-Informationen vergleichsweise weniger bietet. Der Datasphere Catalog unterstützt vor allem SAP-Cloud-Nutzer mit grundlegenden Katalogisierungsfunktionen, bietet also für Unternehmen, deren hybride Struktur auch noch auf SAP BW setzt, weniger Möglichkeiten.

Während sich der Datasphere Catalog in seinem Angebot auf Cloud-Objekte beschränkt (SAP Analytics Cloud und SAP Datasphere), decken Collibra und das Enterprise Glossary alle gängigen SAP Data & Analytics-Konnektoren und -Objekte ab (SAP BW, SAP HANA, SAP Business Objects, SAP Analytics Cloud, Datasphere, S/4).

Des Weiteren unterscheiden sich die drei Catalogs im Informationsgehalt der SAP-Insights, die sie liefern: Während der DSP den detaillierten Aufbau sowie Beziehungen und Feld-Mapping von Cloud-Objekten anzeigen kann, liefert Collibra weniger detaillierte Insights (Aufbau auf Objektebene (Measures, Dimensions), nicht auf Feldebene, keine systemübergreifenden Beziehungen, nur einfacher Verwendungsnachweis), für gängige Data & Anaytics-Objekte – das gelingt vor allem durch die Partnerschaft mit dem britischen Unternehmen Silwood Technology. Das Enterprise Glossary bietet detaillierte Insights über systemübergreifende Abhängigkeiten aller gängigen SAP Data & Analytics-Objekte auf Objekt- (und bald auch auf Feld-)Ebene.

Fazit: Welches Tool ist das Richtige?

Die Wahl des passenden Data Cataloging Tools hängt von den individuellen Anforderungen bezüglich BI-Landschaft und -Ziele ab:

Enterprise Glossary: Ideal für Unternehmen mit SAP-zentrierten Daten, die eine systemübergreifende, schnelle und kostengünstige Lösung suchen und ganzheitlich dokumentieren & analysieren möchte (Lineage bis auf Feldebene, Systemintegration). Auch als co-existierendes Metadatenglossar neben bereits vorhandenen Data Catalogs kann die Lösung Mehrwert bieten. Neben SAP bietet das Enterprise Glossary außerdem Microsoft Power BI-Konnektivität.

Collibra: Perfekt für Unternehmen mit heterogenen Datenlandschaften und hohen Anforderungen an Data Governance. Der Fokus liegt weniger auf tiefergehenden SAP-Insights als vielmehr auf breiter Konnektivität und Governance/Compliance.

Datasphere Catalog: Besonders geeignet für Unternehmen, die bereits SAP Cloud-Lösungen nutzen und eine nahtlose Integration benötigen. Der Haken: Wessen Daten noch überwiegend in SAP BW verwurzelt sind, erhält hier keine Auskunft über Datenquellen, Lineage & Co.

Wer sich auf SAP Cloud-Technologie fokussiert, für den sind DSP Catalog und Collibra brauchbare Werkzeuge – solange man mit eingeschränkter Transparenz leben kann, was die Systemlandschaft angeht.

Wer SAP ganzheitlich – inkl. BW, BO, HANA, SAC & Co. – dokumentieren und analysieren will, kommt an einer Lösung mit echter Feldlineage und Systemintegration nicht vorbei.

💡 Übrigens: Die Technologie, mit der sich das Enterprise Glossary automatisiert tiefe Metadaten-Insights zieht, haben wir sozusagen extrahiert und bieten diese so auch für andere Data Catalogs an: Mit unserer Metadata API. Die API wurde bereits erfolgreich in den Data Catalogs unserer Partner dataspot., synabi, zeenea und Alex Solutions integriert und sorgt dort für die nötigen SAP-Insights, die unsere Partner verständlich visualisiert aufbereiten.

Neugierig geworden?

Kommt unser Kandidat, das Enterprise Glossary, für Ihre Anforderungen infrage? Auf unserer Webseite bekommen Sie einen Eindruck von unserem Tool und seine Use Cases. Dort finden Sie auch die Möglichkeit, das Enterprise Glossary im Rahmen eines 6-monatigen PoCs zu testen oder uns für mehr Fragen zu kontaktieren.

Best-Practice-Beispiel: Unser Kunde, ein international tätiges Handelsunternehmen, nutzt das Enterprise Glossary, um die Datenkatalogisierung in seiner SAP-Landschaft zu optimieren. Durch die direkte Integration konnte das Unternehmen Fachbegriffe und technische Metadaten zusammenführen, was zu einer effizienteren Zusammenarbeit zwischen IT und Fachabteilungen führte (Self-Service). Innerhalb weniger Wochen reduzierte sich die Zeit zur Datenfindung um 40 % und die Einhaltung regulatorischer Anforderungen wurde deutlich verbessert.

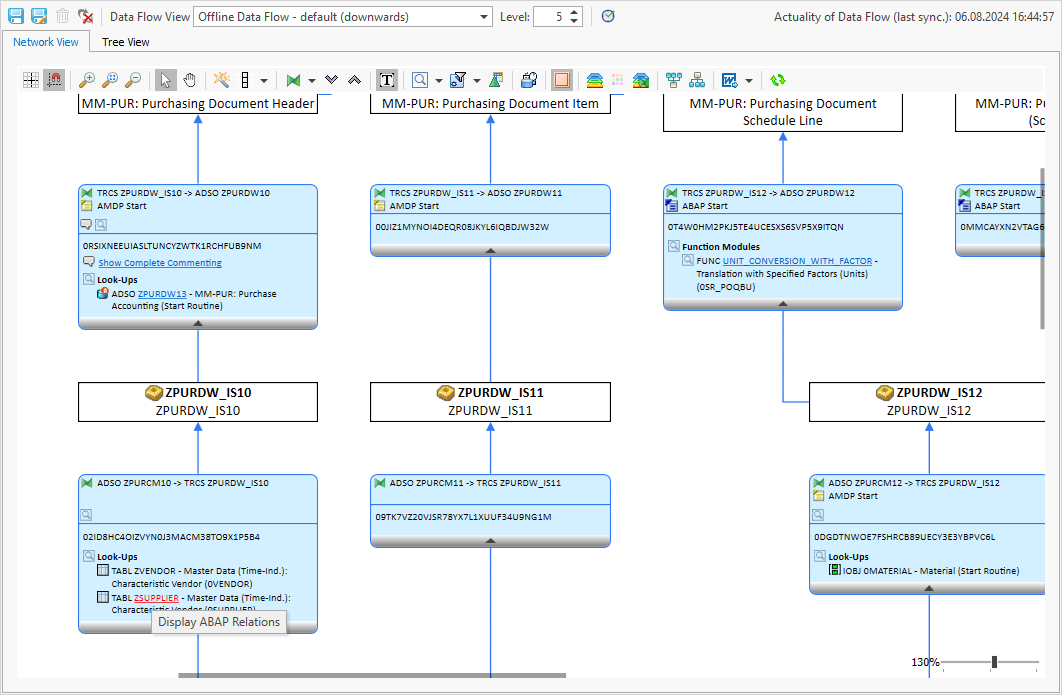

Je komplexer der SAP Datenfluss, desto geringer die Motivation zur technischen Dokumentation. Dieser Blogartikel beleuchtet das Potenzial technischer SAP Dokumentation, die Risiken bei Verzicht darauf und zeigt einen praxisorientierten Lösungsansatz, wie man effizient einen SAP Datenfluss dokumentieren kann: Mit Automatisierung durch SAP AddOn-Tools.

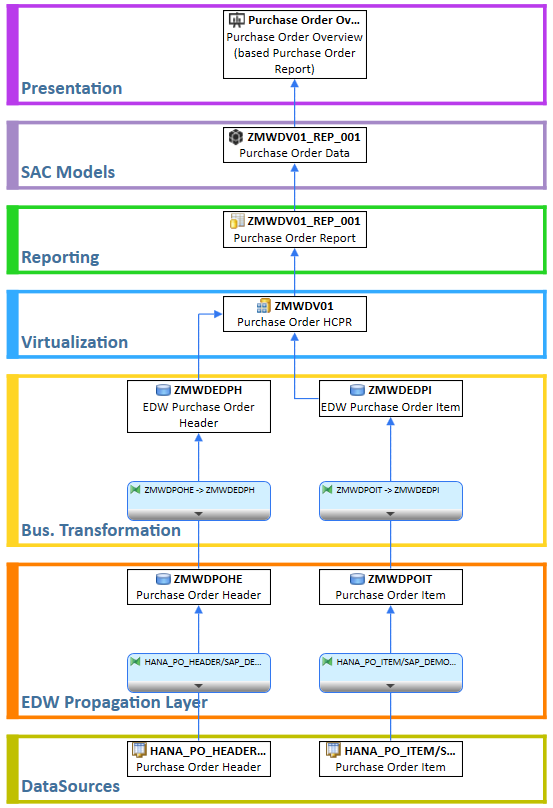

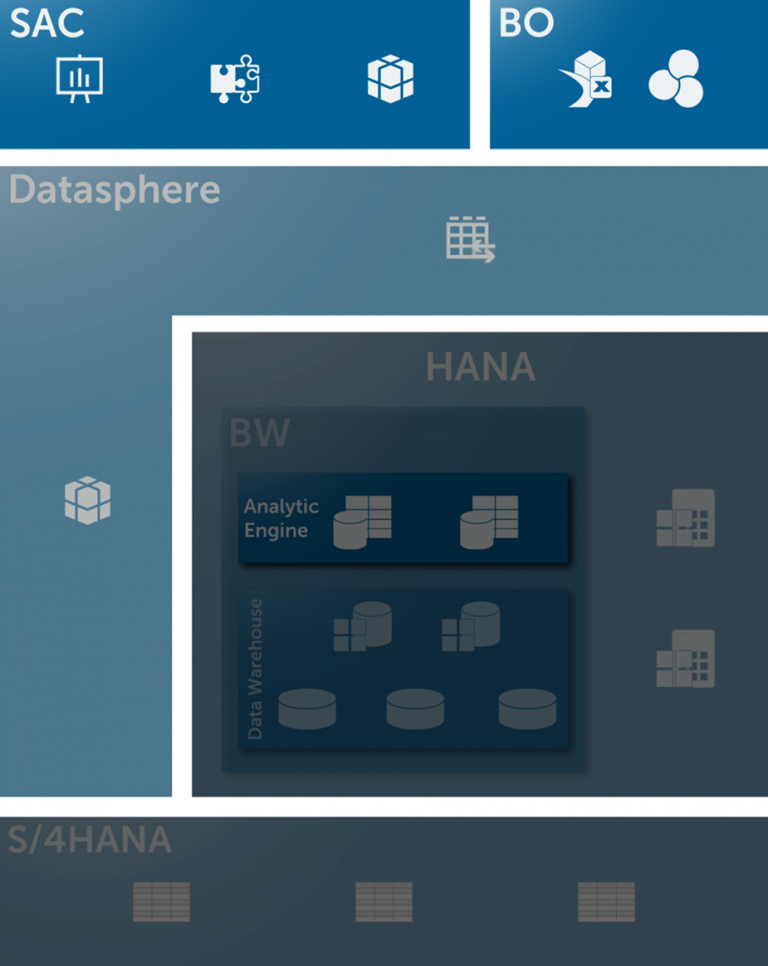

Komplexe SAP Data & Analytics-Strukturen erschweren die Dokumentation

SAC Stories greifen auf Datasphere Views zu, diese wiederum auf Calculation Views in HANA oder Tabellen in S/4HANA, BW Queries, InfoProvider, DataSources… – moderne SAP Data & Analytics-Architekturen kombinieren eine Vielzahl von Systemen und Technologien.

Mit steigender Komplexität sinken die Motivation und Kapazität zur Dokumentation eines langen und verzweigten Datenflusses natürlich enorm – und sowieso: Neue Anforderungen haben Vorrang und werden direkt im System umgesetzt. Doch diese Praxis birgt Risiken – sei es in Hinblick auf Qualität, Compliance oder Entwicklungsgeschwindigkeit. Und auch Potenzial wird so verschenkt. Die Liste von Use Cases, in denen eine technische SAP-Dokumentation von Vorteil ist, ist lang:

Vorteile technische SAP-Dokumentation

- Schneller Wissenstransfer bei Einarbeitung neuer Teammitglieder oder Projektübergaben durch Externe/Interne

- System- und Prozessanalysen durch Abbildung der Datenherkunft, Datentransformation und Data Lineage

- Suche nach Fehlern in Dashboards und Debugging

- Change-Management / Impact-Analysen

- Audits & Compliance-Vorgaben (Nachweis über Datenflüsse, Verantwortlichkeiten, Transformationslogik, etc.)

- Redesigns & Systemmigrationen (Erleichterte Analyse von Alt-Systemen, optimaler Aufbau strukturierter Zielarchitektur, z.B. bei BW on HANA → BW/4 oder Datasphere-Migration)

- Wiederverwendbarkeit & Standardisierung (Dokumentierte Applikationen als Vorlage für Neuentwicklungen)

Game Changer: Automatisierte SAP Dokumentation

Was viele nicht wissen: Dank automatisierter SAP AddOn-Tools ist es längst möglich, von den Vorteilen einer SAP-Dokumentation zu profitieren, ohne Zeit zu verlieren. Über Funktionsbausteine eingebunden dokumentiert der Docu Performer ganze Datenflüsse systemübergreifend auf Knopfdruck.

Folgende Möglichkeiten bietet das SAP-Dokumentationstool:

- Automatische Dokumentation ganzer Datenflüsse oder individueller Objekte sowie angelegter Kommentare dazu

- Export eines strukturierten, durchsuchbaren Dokuments mit Verzeichnis (Word, Excel, PowerPoint, PDF oder HTML) und wahlweise Upload auf Confluence

- Unterstützte Technologien zur Dokumentation: SAP BW – SAP BW/4HANA – SAP Business Objects – SAP Analytics Cloud – SAP Datasphere – SAP ECC – SAP S/4HANA

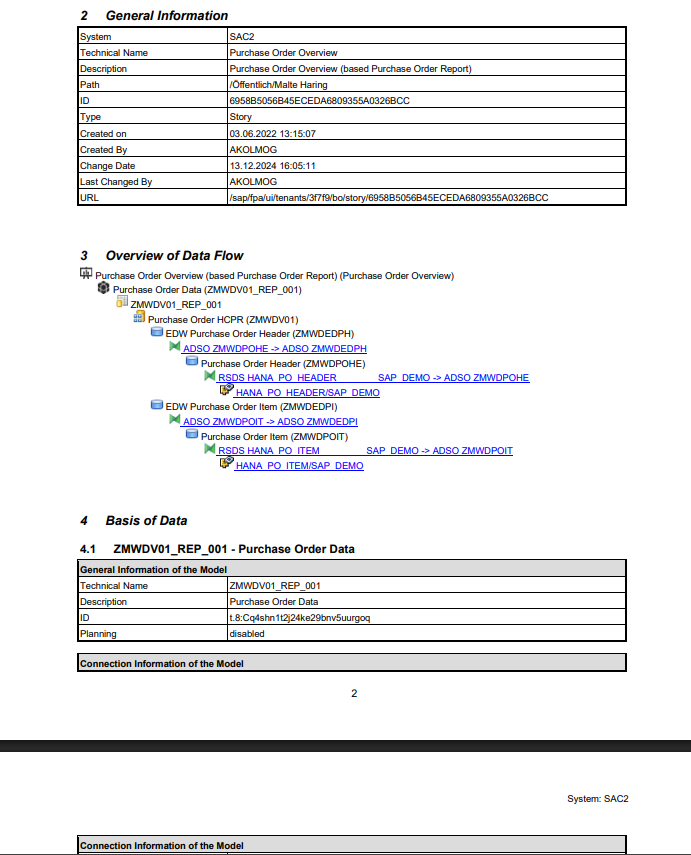

Beispiel: SAP Datenfluss dokumentieren, SAC-Story aus dem Dashboard Einkauf:

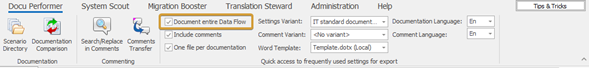

Objektauswahl und Varianten:

In den Einstellungen können Sie zunächst festlegen, ob einzelne oder alle Objekte der Story dokumentiert werden sollen („Document Entire Dataflow“, verfügbar mit Version 24.2) und ob auch bestehende Kommentare zu den Objekten dokumentiert werden sollen. Auch den Detailgrad und die Sprache der Dokumentation können Sie festlegen, um verschiedenen Zielgruppen gerecht zu werden.

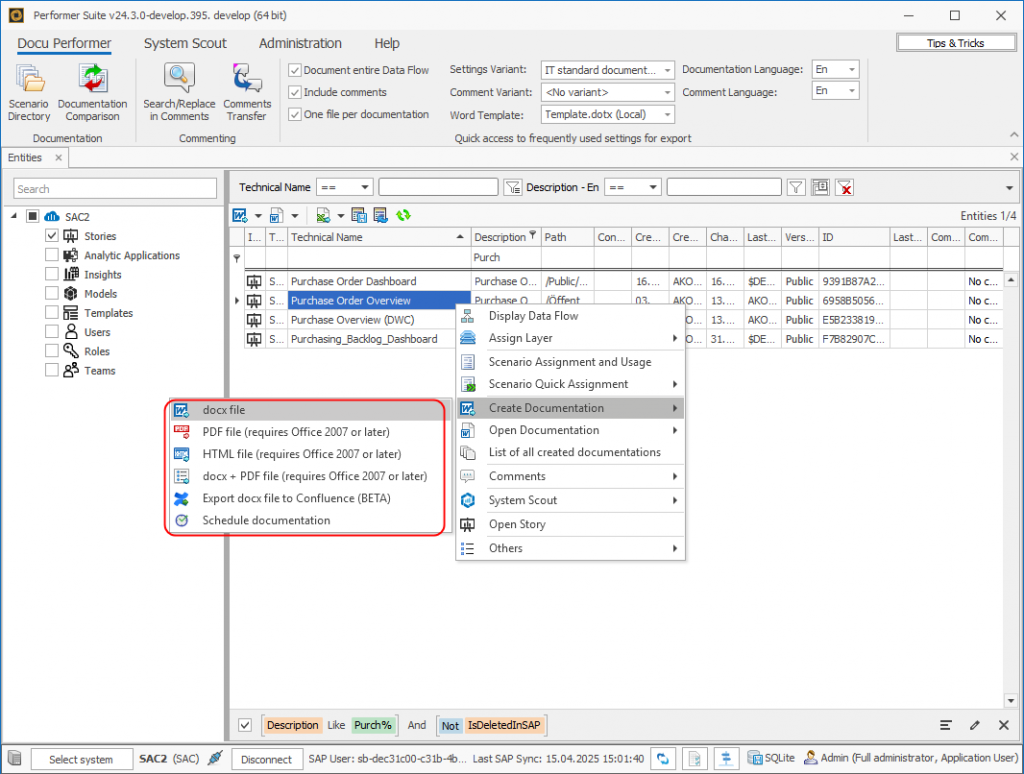

Export:

Als Export-Varianten können Sie ein gewünschtes Dokumentenformat (Word, Excel, PowerPoint, PDF, HTML) auswählen und festlegen, ob das Dokument zentral in Confluence hochgeladen werden soll.

Fertiges Dokument:

Das Resultat ist eine detaillierte Dokumentation, in der alle Objekte des Datenflusses dokumentiert wurden – durchsuchbar und übersichtlich strukturiert. Hier können Sie sich in der exportierten PDF selbst ein Bild vom Informationsgehalt der SAP Dokumentation machen.

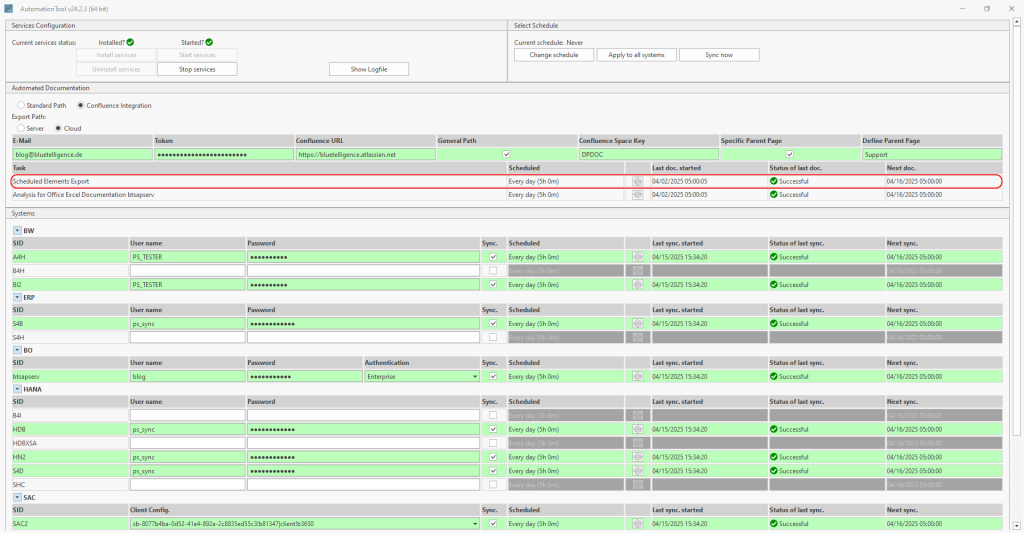

Einplanbarkeit:

Außerdem spannend: Die automatische Aktualisierung. Die Dokumentation kann durch geplante Jobs automatisiert werden, sodass beispielsweise tagesaktuelle Informationen zur Verfügung stehen.

Fazit: SAP Dokumentation muss mit der Systemkomplexität mitwachsen

Manuelle Dokumentation war gestern – in modernen SAP Data & Analytics-Architekturen ist automatisierte Dokumentation kein Luxus, sondern ein entscheidender Faktor für Effizienz, Qualität und Skalierbarkeit. Wer hier frühzeitig auf smarte Lösungen setzt, schafft eine belastbare Basis für agile Weiterentwicklung – ohne ständig bei Null anfangen zu müssen.

Wie sich die automatisierte Dokumentation Ihrer Datenflüsse in der Praxis anfühlt, können Sie ganz einfach ausprobieren: Mit einer kostenlosen Testversion über unsere Webseite.

Self-Service, Data Democracy und dazugehörige Tools wie SAC oder Datasphere sind aus der Business Intelligence-Bubble nicht mehr wegzudenken. Das Interesse an einer Self-Service BI ist groß – und das schon lange: Bereits im Jahr 2016 gaben 80 % der befragten Unternehmen einer BARC-Studie an, bereits Self-Service-BI-Tools zu nutzen oder dies zu planen. Inzwischen sind wir bei einer starken Business-Orientierung der Data & Analytics-Tools und einer veränderte Rolle der Business User angekommen, die nun wesentlich mehr in die Verantwortung genommen werden, Berichte und Dashboards eigenständig zu erstellen – ohne Unterstützung der IT.

Dieser Paradigmenwechsel ist begrüßenswert – effizientere Prozesse und datengetriebene Entscheidungen sind schließlich entscheidend. Doch gerade im Hinblick auf SAP BI-Tools hinkt die Theorie der Self-Service BI der Praxis noch hinterher. Die Beobachtung zeigt häufig: Business User sind noch lange nicht empowert, sondern setzen weiterhin auf Auskünfte und Hilfestellung der IT.

Welche Hindernisse dafür verantwortlich sind, warum sie entstehen und wie der Weg zu einer echten Data Democracy gelingt, erörtert dieser Artikel. Soviel schonmal vorweg: Metadaten sind der Schlüssel.

Status Quo: SAP & Self-Service BI

Der Begriff der Self-Service BI lässt sich im SAP Data & Analytics-Kontext auf zwei Komponenten herunterbrechen: Modellierungsmöglichkeiten und (Meta)Datentransparenz.

SAP Analytics Cloud (SAC) und Datasphere ermöglichen Business Usern, eigenständig Modellierungen vorzunehmen – das funktioniert dank einer intuitiven Benutzeroberfläche und Low-Code-Ansätzen. IT-Kenntnisse sind nicht mehr zwingend nötig, um interaktive Dashboards zu erstellen, Daten zu visualisieren und Ad-hoc-Analysen durchzuführen. Gleichzeitig bietet das Space-Konzept die perfekte Möglichkeit, um isolierte Bereiche aufzubauen, für deren Inhalt die Fachbereiche verantwortlich sind.

In Hinblick auf Datentransparenz bietet die SAP in diesen Tools auch schon einige Werkzeuge, die beim BI Self Service unterstützen – hier vor allem zu nennen:

- die grafische Darstellungen von Datenmodellen

- der integrierte Data Catalog

- die strategische Kooperation mit Collibra

Es sei an dieser Stelle natürlich auch gesagt, dass abzuwarten bleibt, wie sich die Ankündigungen zur Business Data Cloud auf diese beiden Komponenten zukünftig auswirken werden.

So viel zur Theorie – in der Praxis stößt die angesprochene Datentransparenz an ihre Grenzen, wenn ein häufig vertretener Fall eintritt: Neben modernen Tools sind auch ältere SAP-Lösungen Teil der Architektur des Unternehmens. Konkret sprechen wir hierbei in fast allen Unternehmen vom weiter fortbestehenden Einsatz eines oder mehrerer SAP BW-Systeme. Meist sind diese über Jahre und Jahrzehnte gewachsen und hochkomplex. Vielleicht wurden außerdem in der Vergangenheit auch HANA Calculation Views oder CDS Views ausprobiert, die von SAC-Stories konsumiert werden. Und dann gibt es im Frontend gegebenenfalls noch unzählige AfO-Berichte, von denen sich der Fachbereich nicht trennen kann. Und, um nicht nur von SAP zu sprechen: Auch Power BI natürlich wird gerne genutzt.

Wir können stark davon ausgehen, dass dieser hybride Ansatz von alten und neuen Technologien von den meisten Unternehmen auch noch eine ganze Weile gefahren werden wird – unabhängig von der neu verkündeten Möglichkeit, das BW System als Private Cloud Edition in die BDC zu heben.

Grenzen der Self-Service BI

So weit zu den Rahmenbedingungen. Wenn nun ein Business User auf diese Architektur losgelassen wird und BI Self-Service leben soll, gibt es mehrere Bereiche unterhalb der Frontend-Tools SAC, BO und Co., die für ihn ohne tiefgreifende IT-Kenntnisse einer Black Box gleichen – und auf die er ungeachtet dessen auch keinen Zugriff hat:

Man ahnt schon: Der vielversprechende Ansatz der Self-Service BI, nach dem Fachbereiche ohne tiefgehendes technisches Wissen in der Lage sind, Daten zu durchsuchen und Berichte zu erstellen, wird von den Rahmenbedingungen der intransparenten Realität torpediert.

Nach welchen Informationen Business Usern suchen, konnten wir im Austausch mit unseren Kunden erarbeiten und so folgende zentrale Fragestellungen identifizieren, die unter den genannten Bedingungen weiterhin der IT gestellt werden:

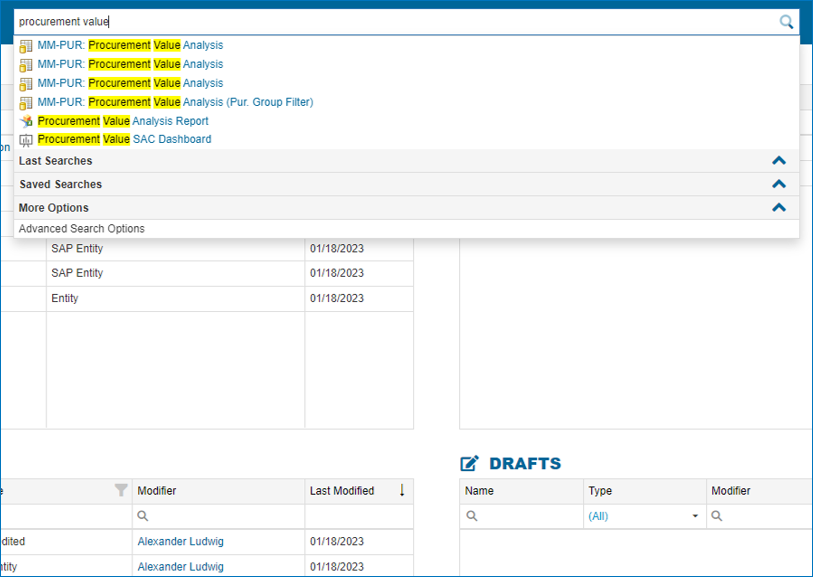

- Welche Berichte oder Dashboards gibt es für meine Fragestellung? Wer ist verantwortlich?

- Wie sind diese Berichte technisch aufgebaut? Welche Filter und Datenquellen werden genutzt?

- Wie wird meine Kennzahl berechnet? Welche Formel steckt dahinter?

- Was hat sich technisch an meinem Bericht seit gestern geändert?

Die ernüchternde Erkenntnis ist also: Allein der Einsatz von SAP-Tools mit Self-Service BI-Funktionalitäten reicht nicht aus, um eine tatsächliche Self-Service BI im Unternehmen zu etablieren. Die Tools liefern Business Usern zu alltagsrelevanten Fragestellungen nicht genügend Informationen und binden sie weiterhin an die IT.

Die Lösung dieses Problems haben wir bereits in der Einleitung angesprochen –

Metadaten als Schlüssel zur funktionierenden Self-Service BI

Genau hier kommt der Main Character ins Spiel – die Metadaten natürlich.

Warum sind sie so entscheidend? Sie enthalten Informationen über die Daten & Datenquellen, über Beziehungen und liefern wertvolle Kontextinformationen. Kurz gesagt: Metadaten machen Daten verständlich und auffindbar. Ohne sie fehlt der Schlüssel, um Daten effektiv zu nutzen.

Diese Metadaten werden den Business Usern (und auch den Entwicklern) leider nicht auf dem Tablett serviert – man muss sie mühsam finden, aufbereiten und dann zugänglich machen. Genau dieser Herausforderung gehen wir bei bluetelligence seit über 15 Jahren Softwareentwicklung nach: Wir durchsuchen die Backend-Tabellen von SAP-Anwendungen, lesen die Metadaten aus, bereiten sie so auf, dass sie verständlich sind.

Die Frage die sich nun zwangsläufig stellt, lautet: Wie kann man Business Usern diese wertvollen Informationen zur Verfügung stellen? Hier kommen Data Catalogs ins Spiel.

Ein unternehmensweiter Data Catalog dient als zentrale Wissensbasis für Metadaten. Er ermöglicht es, Informationen strukturiert bereitzustellen und für eine breite Anwenderschaft zugänglich zu machen. Damit wird er zur Grundlage für echte Datendemokratisierung und unterstützt ein nachhaltiges Datenmanagement.

Im folgenden betrachten wir, wie ein Data Catalog bei den zuvor aufgezeigten Herausforderungen weiterhelfen kann:

Basic Requirements eines Data Catalogs:

- Einfacher und zentraler Zugang für alle Business User, z.B. via Web

Anwenderfreundlich, was UX und UI angeht - Automatische Aktualisierung von technischen Metadaten – im besten Fall einplanbar via jobs

- Unterstützung gängiger BI-Lösungen (SAP, PowerBI, etc.)

- Leichte Durchsuchbarkeit, idealerweise Filtermöglichkeiten

- Aufrufbar aus SAP-Anwendungen (bspw. in SAC Story) heraus

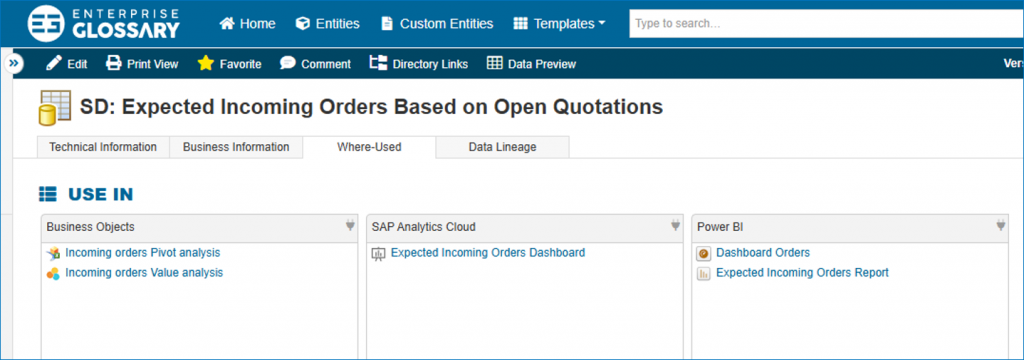

Passende Berichte/Dashboards finden:

- basierend auf technischem Namen

- basierend auf einem Quellobjekt (bspw. BW Query, Analytic Model…), also „Where-Used“

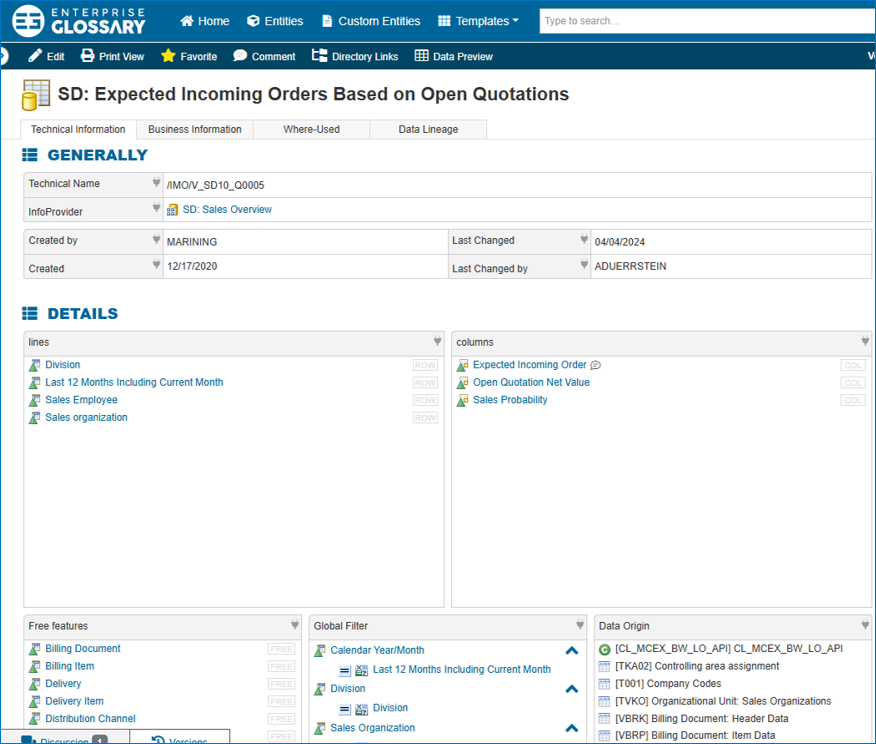

Kontext von Berichten/Dashboards einsehen:

- Technischen Aufbau von allen Berichten/Dashboards in verständlicher Art und Weise einsehen – bspw. Prüfung der Filter auf einen Blick

- Möglichkeit zur Dokumentation abseits von technischen Details bieten – bspw. fachliche Ergänzungen oder Verantwortlichkeiten – hierdurch wird das Verständnis für Daten und die Nutzungsmöglichkeiten für verschiedene Anwendergruppen verbessert

Kennzahlen verstehen

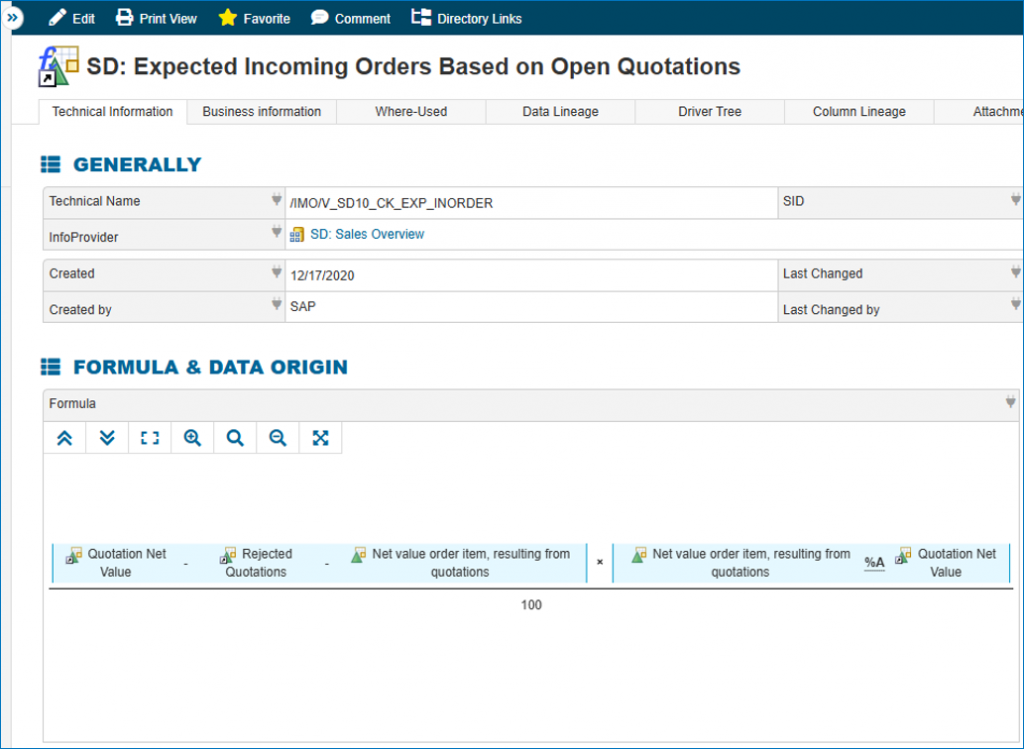

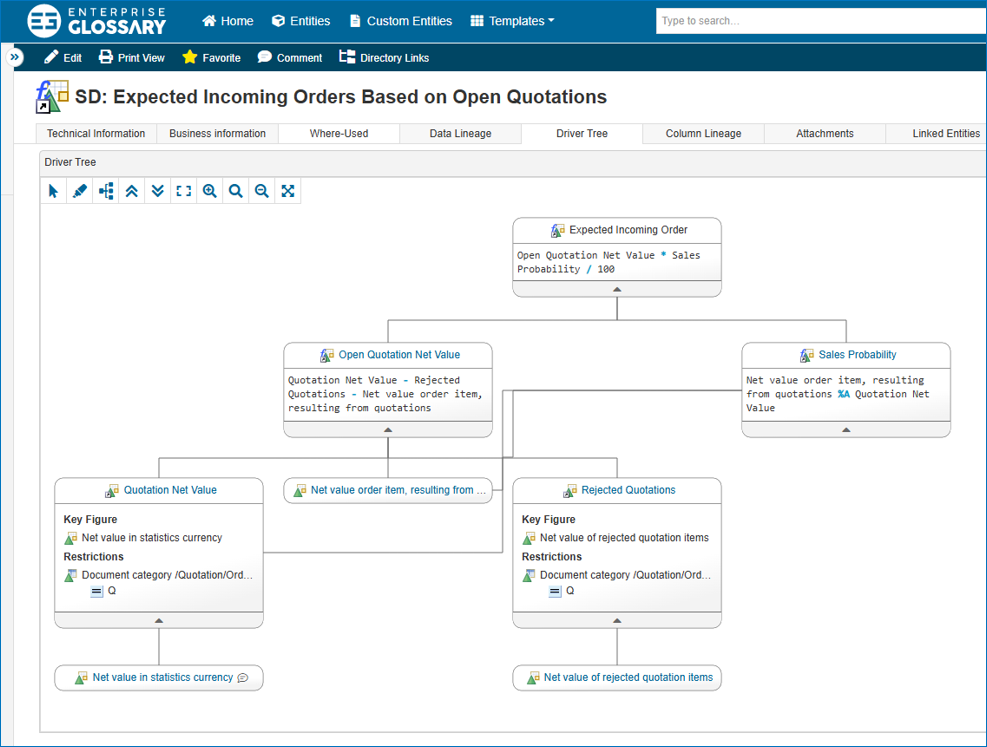

- Formel von berechneten Kennzahlen darstellen

- grafische Ansicht der Zusammenhänge (sogenannter Driver Tree)

Data Lineage:

- Datenquellen schnell mit Hilfe von grafischen Darstellungen identifizieren

Eine Tour durch die Möglichkeiten unseres Data Catalogs "Enterprise Glossary"

Sie sehen gerade einen Platzhalterinhalt von YouTube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr InformationenKey Take Aways

Ein Data Catalog, der den Überblick über die relevanten Metadaten (Datenquellen, Where-Used, Kennzahlenzusammenhänge) enthält und diese für Business User verständlich darstellt, ist der Schlüssel für eine zu Ende gedachte Self-Service BI.

So wird an richtiger Stelle empowert und entlastet:

- Für die Business User gilt dann: Wer den Kontext kennt, ist handlungsfähig und kann fundierte Entscheidungen treffen – schließlich wird von Business Usern zukünftig genau dieses Skill-Set erwartet.

- Und die IT? Die hat künftig hoffentlich durch den Wegfall zahlreicher Tickets mehr Zeit für strategische Weiterentwicklung, innovative Datenlösungen und eine nachhaltige BI-Architektur.

Wenn Sie unseren Data Catalog, das „Enterprise Glossary“ und die darin enthaltenen Insights zu Metadaten aus SAP BW, BW/4, S/4, SAC, HANA und Datasphere sowie Microsoft Power BI einmal selbst ausprobieren möchten, geht das ganz einfach und kostenlos über eine kurze Demo-Anfrage über unsere Webseite.

Einleitung

Wer schon einmal ein SAP BW-Migrationsprojekt begleitet hat, weiß: Je größer und komplexer das System, desto wichtiger ist es, effizient und möglichst standardisiert vorzugehen. Die Migration von SAP BW nach SAP Datasphere stellt Unternehmen außerdem noch vor die Herausforderung, von Ihrer gewohnten On-Premise-Lösung in eine Public-Cloud-Umgebung zu wechseln. Dieser Transformationsprozess erfordert nicht nur eine sorgfältige Planung, sondern auch ein klares Zielbild, wie man die Vorteile der neuen Cloud-Technologie optimal nutzen und gleichzeitig bewährte Geschäftslogiken bewahren kann.

Für letzteren Aspekt bietet sich die SAP BW Bridge an – sie fungiert als Bindeglied zwischen den Systemen und ermöglicht die Migration bestehender Modelle und Geschäftslogiken. In diesem gemeinsamen Blogbeitrag vom Beratungsunternehmen NextLytics und Softwareanbieter bluetelligence soll es anhand eines Praxisbeispiels aus einem Projekt darum gehen, wie dieser Ansatz erfolgsversprechend durchgeführt werden kann. Denn: Die Bridge zu nutzen bedeutet natürlich, teilweise auf Vorteile zu verzichten, die ein Greenfieldansatz in Datasphere verspricht. Dem gegenüber bietet sie als „schnellere“ Migrationsoption“ jedoch viele Vorteile, die es abzuwägen lohnt. Für den Einsatz der BW Bridge sprechen insbesondere folgende Gründe:

- Investition in BW-Modelle: Oft wurde viel Aufwand in die Entwicklung spezifischer BW-Modelle gesteckt, die komplexe Business-Logiken und individuelle Datenflüsse – teilweise mit umfangreicher ABAP-Logik – enthalten.

- Eingeschränkte Verfügbarkeit von CDS-basierten Extraktoren: In Fällen, in denen SAP-basierte Quellsysteme noch nicht die erforderlichen CDS-Extraktoren bereitstellen (z.B. bei SAP ECC-Systemen), müssen klassische S-API-Extraktoren genutzt werden. Es wird jedoch davon abgeraten, diese direkt an SAP Datasphere anzubinden, da Einschränkungen bestehen, beispielsweise wenn DataSources zwingend Selektionsfelder benötigen oder bestimmte Delta-Verfahren nicht unterstützt werden.

- Mangel an spezifischen Kompetenzen: Häufig verfügen Teams über umfangreiche BW- und ABAP-Expertise, während Know-how zu SQL oder Python, die in SAP Datasphere genutzt werden – nicht ausreichend vorhanden ist, um die Modelle nativ neu zu erstellen.

In unserem folgenden realen Projektbeispiel trafen all diese Faktoren zu. Es handelte sich um ein umfangreiches, historisch gewachsenes BW-System eines Energieversorgers mit hochspezialisierten Modellen, die den Besonderheiten des komplexen und stark regulierten Energiemarktes Rechnung tragen. Das Projektziel bestand darin, die bestehenden Modelle, Business-Logiken und Datenflüsse zu erhalten und lediglich den Reporting-Layer in SAP Datasphere neu abzubilden. In diesem Kontext erwies sich auch der Einsatz der Performer Suite von bluetelligence als entscheidender Erfolgsfaktor für eine effiziente und zielgerichtete Migration.

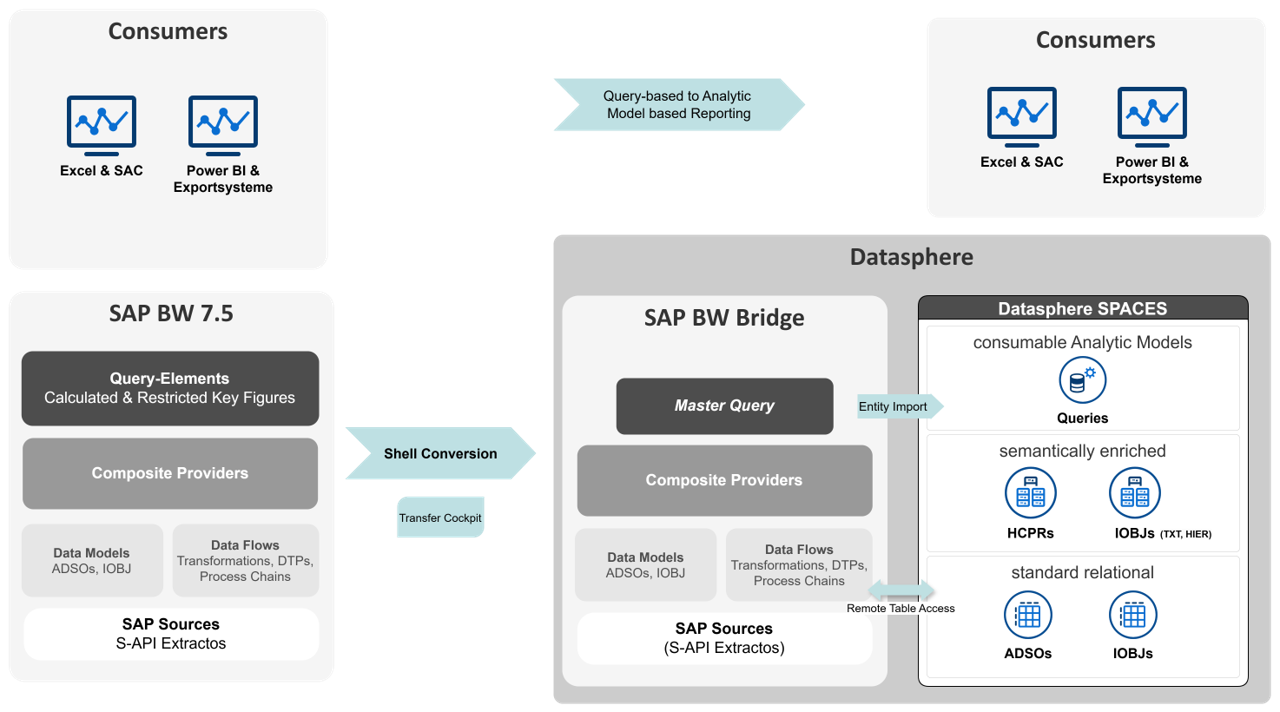

Zielbild und Vorgehensweise

Bevor wir das detaillierte Zielbild des Projektes vorstellen, ist es wichtig, eine Besonderheit der BW Bridge in Verbindung mit SAP Datasphere zu erläutern. Obwohl Queries bei der Migration in die BW Bridge übertragen werden können, können sie nicht wie im klassischen BW-System ausgeführt oder als Quelle für andere Datenziele verwendet werden. Stattdessen werden Queries in der BW Bridge als Metadaten bereitgestellt. Das bedeutet, sie können importiert und als Grundlage für den Entity-Import in SAP Datasphere genutzt werden. Diese Eigenschaft spielt eine zentrale Rolle in unserer Vorgehensweise.

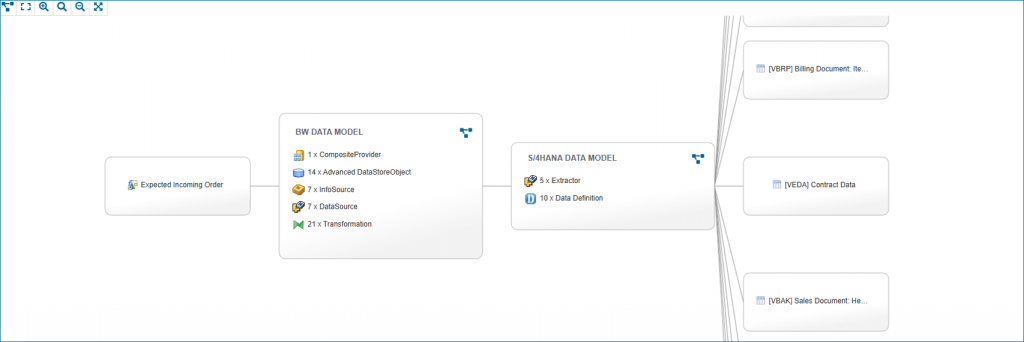

Das folgende Schaubild veranschaulicht das Zielbild des Projekts:

Im Rahmen des Projektes wurden mehrere zentrale Schritte definiert, die für die Migration von SAP BW nach SAP Datasphere entscheidend waren:

1.Toolgestützte Übertragung via Shell Conversion:

- Migration der Modelle und Datenflüsse bis zum Composite Provider

2. Entwicklung und Übertragung von Master-Queries:

- Abbildung aller globalen und lokalen berechneten und eingeschränkten Kennzahlen sowie aller für das Reporting relevanten Merkmale

- Erstellung pro Composite-Provider

- Übertragung mittels Shell Conversion

3. Generierung der Analytics Models:

- Entity-Import der Master-Queries

- Automatische Erstellung der Analytics Models basierend auf importierten Queries

4. Umstellung des Reportings:

- Umstellung des query-basierten Reportings auf Analytics Models in den verschiedenen Frontend-Tools

Durch den gezielten Einsatz des Entity-Imports konnten wir einen Großteil der erforderlichen Objekte automatisch generieren lassen und damit den Zeitaufwand für die Modellierung in Datasphere erheblich reduzieren.

Die Darstellung in dem Schaubild ist bewusst vereinfacht und fokussiert sich auf die Kernaspekte der Migration. Das vollständige Konzept umfasst zusätzliche wichtige Komponenten:

- Weitere Non-SAP Quellsysteme

- Detailliertes Layer-Konzept

- SPACE-Konzept für die Zusammenarbeit von Central IT und Fachbereichen

- Implementierung von Berechtigungen über Data Access Controls

- Berücksichtigung spezifischer Anforderungen je nach Datenabnehmer (z.B. via ODBC oder OData)

Für detaillierte Informationen können Sie sich gerne den NextLytics-Blogbeitrag zur Referenzarchitektur SAP Datasphere ansehen: Blog Nextlytics: Datasphere Referenzarchitektur – Überblick & Ausblick

Praktischer Einsatz der Performer Suite im Projekt

Master-Query-Analyse

Eine der zentralen Herausforderungen des Projekts bestand also darin, die Kennzahl-Definitionen als Vorlage für die Master-Queries zu erstellen – dafür mussten wir die Strukturen einer Vielzahl an Queries aus dem BW-System des Kunden analysieren. Schon in der Planungsphase war uns klar, dass wir dafür eine leistungsstarke, toolgestützte Lösung benötigen würden. Als Partner von bluetelligence kannten wir die Stärken der Performer Suite und entschieden uns daher für den Einsatz einer zeitlich begrenzten Lizenz im Projekt.

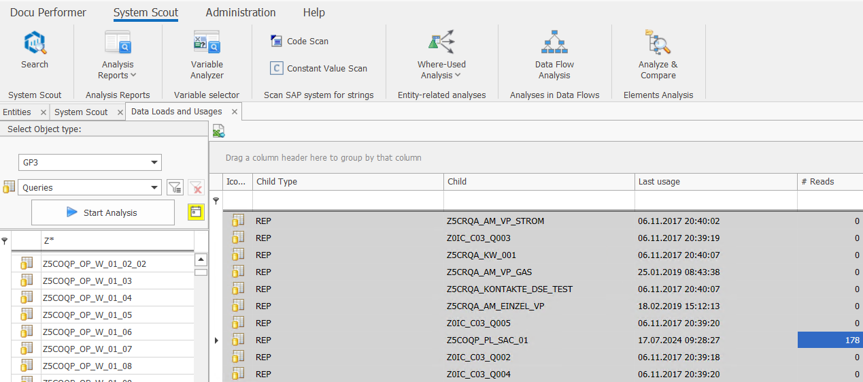

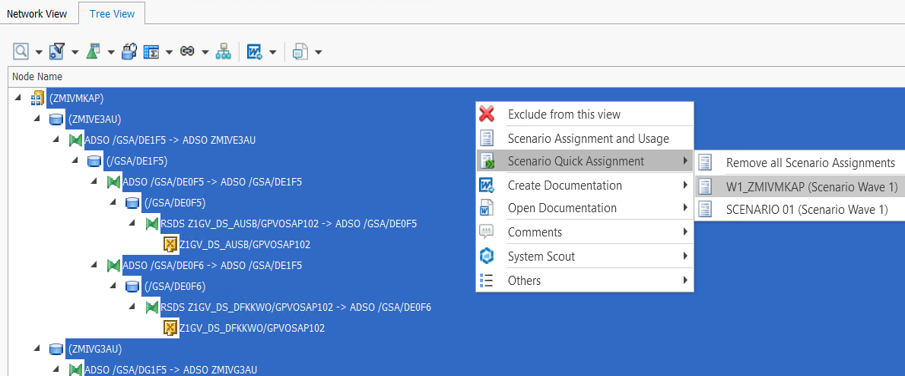

Ziel war es, pro Composite Provider eine Master Query zu erstellen, die alle globalen und lokalen berechneten und eingeschränkten Kennzahlen sowie alle für das Reporting relevanten Merkmale enthält. Um nur die für das Reporting relevanten Kennzahlen zu übernehmen, analysierten wir zunächst mit der System Scout Analyse Data Loads and Usages alle in den letzten 18 Monaten ausgeführten Queries:

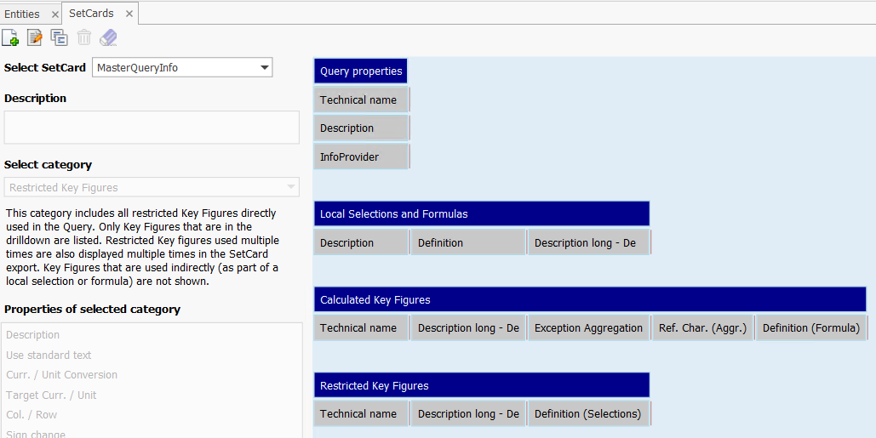

Diese Analyse lieferte uns pro Composite Provider eine Liste aller relevanten Queries. Für eine zentrale Auflistung der Definitionen aller globalen und lokalen berechneten und eingeschränkten Kennzahlen griffen wir auf den Query SetCard Designer zurück. Wir erstellten eine SetCard, in der wir alle erforderlichen Informationen der in den Queries verwendeten Kennzahlen erfassten:

Mit Hilfe des Docu Performers (ein Tool der Suite) konnten wir anschließend die Queries gemäß unserer SetCard-Vorlage nach Excel exportieren. Dabei war es wichtig, die Einstellung One file per documentation zu deaktivieren, um nicht für jede Query eine separate Excel-Datei zu erzeugen. Das Resultat war eine konsolidierte Übersicht der Kennzahl-Informationen pro Composite Provider. Diese Übersicht nutzten wir als Vorlage für die Erstellung der Master-Queries.

Planung der Migration und Datenfluss-Analyse

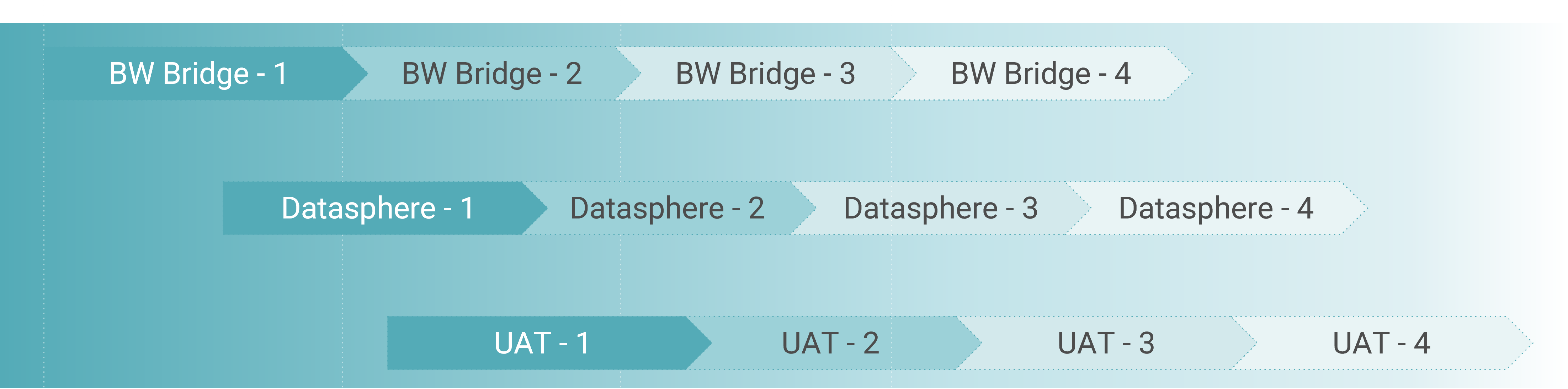

Zu Beginn der Migration entwickelten wir einen strukturierten Wellenplan, der auf eine schrittweise Umstellung während der Projektlaufzeit setzte, anstatt eines einzigen großen Big Bang am Ende. Dieser Ansatz ermöglichte es uns, Reporting-Szenarien iterativ von SAP BW nach SAP Datasphere zu migrieren, zu testen und User Acceptance Tests (UAT) mit den Fachbereichen durchzuführen.

Diese Strategie bot mehrere Vorteile:

- Risikominimierung durch schrittweise Umstellung

- Frühzeitige Stabilisierung der neuen Umgebung

- Kontinuierliches Lernen und Optimieren der Vorgehensweise

- Flexibilität, um auf Herausforderungen zu reagieren, ohne das Gesamtprojekt zu gefährden

Der Kunde nahm in einem ersten Schritt die Aufteilung der Wellenplanung auf Ebene von BW InfoAreas vor. Basierend auf diesen Vorgaben identifizierten wir die betroffenen CompositeProvider mithilfe der Entity-Listen in der Performer Suite. Wir erstellten Listen dieser Provider, angereichert mit zusätzlichen Attributen, und stellten sie dem Kunden zur Verfügung. Dies ermöglichte eine präzise Nachjustierung der Planung, da nicht alle CompositeProvider aus einer InfoArea aufgrund von Abhängigkeiten zwangsläufig in der gleichen Welle migriert werden konnten.

Unsere Aufgabe war es, die Datenflüsse je Composite Provider vollständig und reibungslos mit dem BW Conversion-Tool als Shell-Conversion zu migrieren. Obwohl das Conversion Tool Abhängigkeiten durch eine Scope-Analyse selbst ermitteln kann, erwies es sich als sinnvoll, die Objekte manuell auf mehrere Conversion Tasks zu verteilen. Die automatische Scope-Analyse liefert oft sehr umfangreiche Objektlisten, was das Risiko von Abbrüchen bei komplexen Abhängigkeiten erhöht. Zudem werden bestimmte Abhängigkeiten, wie Lookups in ABAP-Transformationen, nicht automatisch erkannt.

Unsere Lösung bestand darin, den Scope pro Conversion-Schritt manuell zu definieren, um damit eine bessere Handhabbarkeit zu erreichen und die Migrationskomplexität zu reduzieren. Basierend auf dieser Vorgehensweise entwickelten wir folgende Priorisierung für die Migration:

- InfoProvider (InfoObjekte, aDSOs, Composite Provider)

- Übertragung nativer DDIC-Objekte via ABAPGit in den ABAP Stack der BW Bridge (z.B. Lookups auf Z-Tabellen in Transformationen, Auslagerung von Routinen-Coding in ABAP-Klassen)

- Transformationen

- DTPs und Prozessketten

Die DDIC-Objekte mussten manuell auf der BTP ABAP Cloud Umgebung der BW Bridge angepasst und aktiviert werden. Diese Umgebung ist restriktiver als ABAP Classic und erlaubt nur von SAP freigegebene APIs. Die meisten bestehenden ABAP-Entwicklungen erforderten daher ein erhebliches Refactoring.

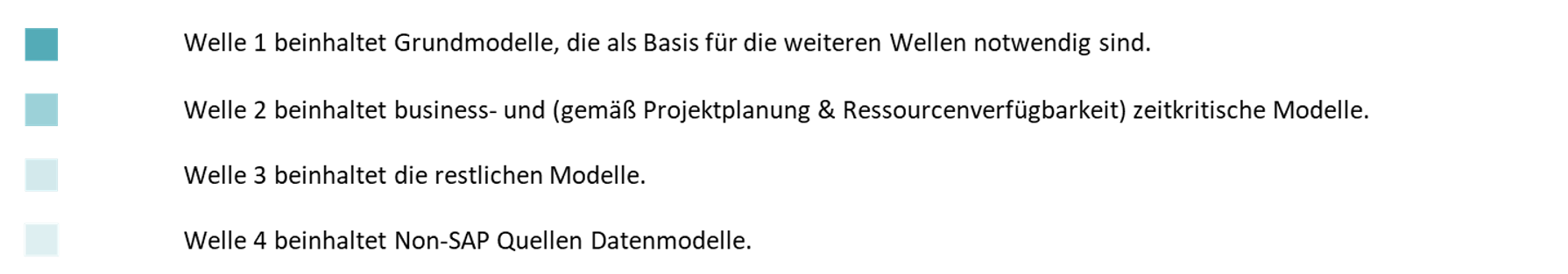

Für die Erstellung der Scope-Listen benötigten wir pro Composite-Provider eine vollständige Auflistung aller Objekte des Datenflusses, einschließlich Transformationen und DTPs. Hierfür nutzten wir die Datenfluss-Analyse in der Performer Suite. Diese ermöglichte es uns, alle Objekte des Datenflusses einem Szenario (in unserem Fall einer Migrationswelle) zuzuordnen:

Anschließend konnten wir in der Entity-Liste der Performer Suite alle Objekte durch Selektion auf das entsprechende Szenario auswählen und als Liste ausgeben.

Diese Listen dienten als Arbeitslisten für die Migration und wurden mit zusätzlichen Informationen (z.B. Transformation verwendet ABAP-Coding) und dem Migrationsstatus angereichert. Dieser Ansatz erlaubte uns eine transparente und strukturierte Verwaltung der zu migrierenden Objekte für jede Welle.

Weitere Anwendungsbereiche im Projektverlauf

Die Performer Suite erwies sich als vielseitiges Werkzeug in unserem Migrationsprojekt. Besonders wertvoll waren die einfachen Möglichkeiten, schnell Listen von BW-Objekten für verschiedene Zwecke zu erstellen.

- Für Ad-hoc Analysen bot die Suite (speziell der System Scout) schnelle Einblicke in Datenflüsse, die sich als detaillierter und benutzerfreundlicher erwiesen als die Datenfluss-Ansicht in den BW-Modelling-Tools.

- In Fällen, in denen Modelle nicht migriert, sondern archiviert wurden, nutzten wir die Suite zur schnellen Erstellung von kompletten Modell-Dokumentationen

- Für die Entwicklungstests war die Suite besonders nützlich, um schnell zu ermitteln, welche InfoProvider über welche Prozessketten geladen werden. Diese schnelle Übersicht hat uns dabei geholfen, den Testprozess für die Entwicklungstests effizienter zu managen.

Herausforderungen und Erkenntnisse im Projektverlauf

Im Laufe des Projekts stießen wir als Berater trotz Tool-Support natürlich auch auf Herausforderungen und Limitationen. Dies betraf vor allem Einschränkungen seitens SAP, aber auch Möglichkeiten, die die Performer Suite (noch) nicht bietet.

Der Export der Query Set Cards erwies sich für 3.x Query-Versionen als problematisch, was manuelle Überprüfungen erforderlich machte. Bei größeren Query-Selektionen traten gelegentlich Abbrüche auf, sodass wir die zu einem Composite Provider gehörenden Queries auf mehrere Export-Jobs aufteilen mussten. Die Konsolidierung der einzeln dokumentierten Queries auf einem Sheet erforderte zusätzlichen Aufwand, den wir durch ein selbst entwickeltes Makro bewältigten. Eine zielgerichtetere Analyse aller globalen und lokalen Kennzahlen eines Composite Providers, beispielsweise als System Scout Analyse, wäre hier zukünftig wünschenswert.

Das größere Hindernis für unseren Ansatz der Master-Queries waren die umfangreichen Restriktionen beim Entity-Import in Datasphere, die in einer SAP Note detailliert aufgeführt sind (https://me.sap.com/notes/2932647). Der Importprozess erwies sich als intransparent, da nicht ersichtlich war, welche Probleme auftraten und manuelle Korrekturen erforderten. Einige Features verhinderten den Import komplett, andere wurden übersprungen, was zu unvollständigen Kennzahldefinitionen führte. Besonders gravierend waren die Einschränkungen bei den unterstützten Formeloperatoren. Die Beschränkung auf lediglich die Grundoperationen (+, -, *, /) macht den Entity-Import für Queries in der Praxis nahezu unbrauchbar. Reale Queries weisen häufig Komplexitäten auf, die weit über diese einfachen Operationen hinausgehen. Angesichts dieser Probleme erwies sich die manuelle Anlage der Kennzahlen in Datasphere letztendlich als effizienter. Wir beschränkten den Entity-Import auf die Composite Provider, aus denen wir dann die Analytic Models erstellten, und legten die Kennzahlen manuell in den Analytics Models an. Dabei nutzten wir die Listen der Query Set Cards als Grundlage, die wir für die Master Queries erstellt hatten.

Bei der Erstellung der Objektlisten für die Migrationswellen stießen wir in der Performer Suite auf eine weitere Herausforderung: Die Datenfluss-Analyse ermöglichte keine direkte Zuordnung der DTPs zu den Szenarien. Wir mussten in der Entity-Ansicht über die Parent-Spalte iterativ die InfoProvider aus dem Szenario abprüfen, um festzustellen, welche DTPs zu welchen InfoProvider gehören, und diese dann nachträglich dem Szenario zuordnen. Eine einfachere Funktionalität zur ganzheitlichen Erfassung aller Komponenten eines Datenflusses, einschließlich DTPs, ohne die Notwendigkeit von Workarounds, hätte den Prozess erheblich vereinfacht und beschleunigt.

Fazit und Ausblick

Abschließend lässt sich sagen, dass der Einsatz der Performer Suite sich in unserem Projekt als äußerst wertvoll erwiesen hat, um den manuellen Aufwand und potenzielle Fehlerquellen zu reduzieren und den gesamten Migrationsprozess zu beschleunigen. Die Projektlizenz bot den Vorteil, dass wir (NextLytics) nur eine temporäre Lizenz für den spezifischen Anwendungsfall erwerben mussten. Unser Anspruch war es nicht, die Performer Suite in den Alltag der IT zu integrieren, sondern sie gezielt für unseren Zweck zu nutzen. Daher war auch kein Expertenwissen in allen Facetten des Tools erforderlich.

Wir sind uns bewusst, dass wir möglicherweise noch mehr hilfreiche Informationen aus dem Tool hätten herausholen oder direkt mit den Listen im Tool hätten weiterarbeiten können. Oft griffen wir auf die altbewährte Methode zurück, die wir bei Kunden häufig sehen und vor der wir normalerweise warnen: Den Export nach Excel, gefolgt von einer kreativen Weiterbearbeitung der Daten. Aber manchmal muss man eben pragmatisch sein! Wenn es für die Projektbeteiligten, die nicht alle Zugang zum Tool hatten, einfacher war, mit Objektlisten in der vertrauten Umgebung von Excel zu arbeiten, dann war das von unserer Seite völlig in Ordnung.

Neben den bereits genannten Features im Hinblick auf Kennzahlen- und Datenfluss-Analyse sehen wir noch spannendes Potenzial für zukünftige Erweiterungen, die den Nutzen der Performer Suite in solchen Projekten weiter steigern könnten:

- Mehr ABAP-basierte Informationen in der Datenfluss-Analyse, insbesondere im Hinblick auf die ABAP Cloud Sprachsyntax. Es wäre beispielsweise sehr hilfreich, wenn man in der Datenfluss-Analyse sehen könnte, welche Transformationen ABAP-Coding verwenden, das nicht ABAP Cloud-kompatibel ist.

- Es ist erfreulich zu sehen, dass bluetelligence massiv in den Ausbau ihrer Analysen Richtung SAP Datasphere und SAP Analytics Cloud investiert. Neben Views werden künftig auch Analytics Models und Task Chains über die Performer Suite analysierbar sein, was in Migrationsprojekten beim Abgleich der alten BW-Welt mit der neuen Datasphere-Welt helfen wird. Mit unserer aktuellen Version des Tools konnten wir uns leider nur gegen das alte BW-System verbinden, nicht jedoch gegen Datasphere bzw. BW Bridge.

- Ideal wäre es natürlich, wenn der Migration Booster, der als Migrationssupport für BW zu BW/4HANA dient, künftig auch für BW Bridge-Projekte genutzt werden könnte. Dieser ermöglicht im Vergleich zum SAP Conversion Tool eine deutlich komfortablere und gezieltere Migration und erlaubt auch die Vergabe neuer Namenskonventionen. Ob SAP hierfür die APIs auf der BTP bereitstellt bzw. ob der Markt für BW Bridge-Migrationen groß genug ist, um eine solche Investition zu rechtfertigen, ist fraglich. Aber man darf sich ja noch was wünschen, ist ja bald Weihnachten 🙂

Zum Schluss an dieser Stelle noch der Hinweis seitens bluetelligence, dass Sie über das bei der Migration eingesetzte Tool, den System Scout, hier mehr erfahren:

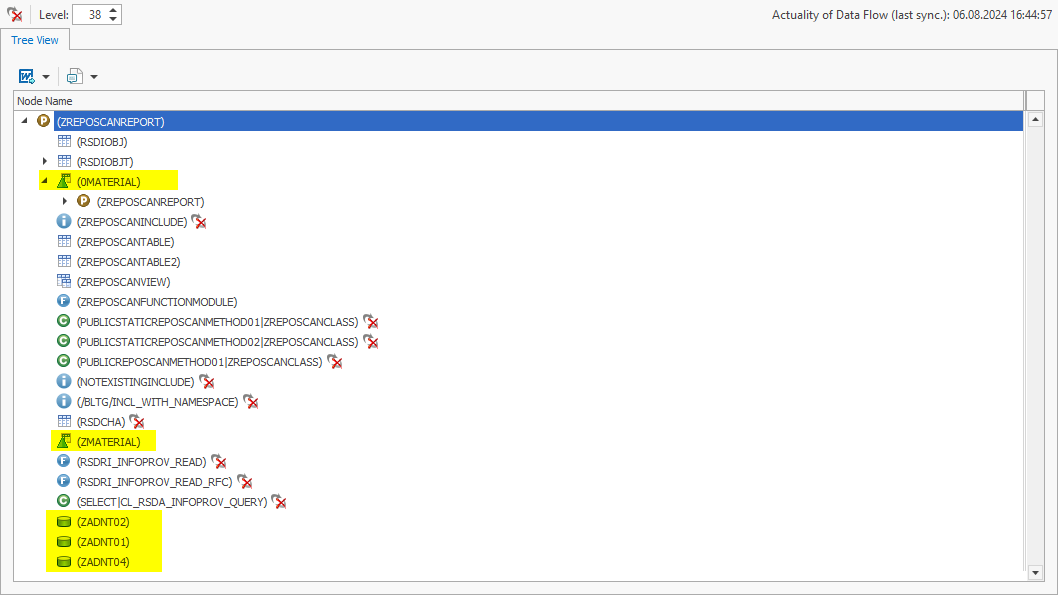

Dieser Artikel beleuchtet die Herausforderungen und Lösungsansätze im Bereich ABAP-Programmierung, die als zentrale Programmiersprache im SAP-Umfeld dient. Im ersten Teil wird ABAP vorgestellt, einschließlich seiner Rolle bei der Steuerung und Erweiterung von Geschäftsprozessen in Unternehmen und der Vielfalt an ABAP-Objekten. Dann werden typische Herausforderungen im Umgang mit ABAP-Coding in großen Unternehmen beschrieben. Zum Schluss wird der Einsatz automatisierter AddOn-Tools beleuchtet, die Transparenz und Effizienz in der ABAP-Entwicklung steigern. Anhand eines Use Cases wird gezeigt, wie diese helfen, Code-Strukturen und Abhängigkeiten schneller und präziser zu analysieren sowie zu dokumentieren.

1. ABAP-Code verstehen: Definition, Einordnung und zugehörige Objekte

ABAP (Advanced Business Application Programming) ist eine von SAP entwickelte Programmiersprache, die hauptsächlich für die Entwicklung von Anwendungen im SAP-Umfeld verwendet wird. Mit der SAP als weltweit führendes Unternehmen für Unternehmenssoftware ist ABAP damit eine der Hauptsprachen, wenn es darum geht, Geschäftsprozesse innerhalb von Anwendungen zu steuern und zu erweitern.

Obwohl ABAP ursprünglich prozedural war, unterstützt es heute auch objektorientierte Programmierung, ähnlich wie Java oder C++. Dies erleichtert es, moderne Softwareentwicklungsprinzipien zu implementieren.

In einem großen Unternehmen kann die Anzahl der ABAP-Objekte (Programme, Klassen, Funktionsbausteine, Reports, Module usw.) in die Zehntausende gehen. Dies umfasst:

- Reports: Programme, die für das Abrufen, Verarbeiten und Darstellen von Daten verwendet werden (mehr Infos dazu gibt es hier)

- Funktionsbausteine: Wiederverwendbare Module in ABAP, die spezifische Aufgaben kapseln und in Programmen aufgerufen werden (mehr Infos dazu gibt es hier)

-

Formulare: Benutzerdefinierte Formulare wie Rechnungen oder Lieferscheine.

-

Erweiterungen: User Exits, BAdIs (Business Add-Ins) und andere Mechanismen zur Anpassung des SAP-Standards.

2. Herausforderungen im ABAP-Coding meistern

Gewachsene Entwickler-Teams in großen Unternehmen haben angesichts der Fülle an ABAP-Coding häufig mit intransparenten Abhängigkeiten zu kämpfen. Die Folge sind Fehler, eine erhöhte Datenmodell-Komplexität, schwere Wartbarkeit und Risiken bei Systemupdates. Wie diese Anhängigkeiten überhaupt zustande kommen, erläutern wir im Folgenden:

a) Fehlende oder unzureichende Dokumentation vermeiden

Eine der häufigsten Ursachen für intransparente Abhängigkeiten ist eine unzureichende oder nicht vorhandene Dokumentation. In vielen Projekten wird der Fokus auf die Entwicklung von Funktionalität gelegt, während der Dokumentationsaspekt vernachlässigt wird. Es ist jedoch essentiell, für die “Nachwelt” festzuhalten, wie verschiedene Programme, Module und Datenstrukturen miteinander verknüpft sind. Ohne klar definierte Anforderungen, zugewiesene Verantwortliche und die kontinuierliche Aktualisierung der Dokumentation wird es schwierig, Abhängigkeiten zu erkennen, denn: Reverse Engineering über mehrere Systemtypen hinweg ist enorm aufwendig.

b) Historisch gewachsenen Code managen

SAP-Systeme und ihre ABAP-Codes bestehen oft über viele Jahre hinweg und werden kontinuierlich angepasst und erweitert. Im Laufe der Zeit entstehen immer mehr benutzerdefinierte Funktionen, schnell implementierte Lösungen, Workarounds und Erweiterungen, die ursprünglich auf kurzfristige Anforderungen reagieren sollten. Selten bis nie wird hier aufgeräumt, alte Module/Programme werden weiterhin verwendet, obwohl neue Lösungen existieren und Änderungen werden zum Teil ohne die Berücksichtigung des Gesamtsystems vorgenommen. So passiert es, dass diese „gewachsenen“ Strukturen nicht mehr klar nachvollziehbar sind, insbesondere wenn verschiedene interne und externe Entwickler oder Teams über die Jahre an denselben Programmen gearbeitet haben.

c) Fehlende Modularität und Wiederverwendung auf dem Schirm haben

In der ABAP-Entwicklung werden häufig globale Daten und Funktionen verwendet, die in vielen verschiedenen Programmen eingebunden sind. Wenn Entwickler globale Klassen, Datenbanktabellen oder Funktionsbausteine nutzen, ohne eine saubere Modularisierung und klare Schnittstellen zu definieren, entstehen enge Abhängigkeiten zwischen verschiedenen Teilen des Systems. Auch das Kopieren von Code anstelle der Nutzung gemeinsamer Bausteine führt dazu. Diese Abhängigkeiten sind oft schwer zu erkennen und nicht immer dokumentiert.

d) Ungeplante und unkoordinierte Anpassungen vermeiden

In größeren SAP-Installationen arbeiten häufig mehrere Entwickler oder Teams gleichzeitig an unterschiedlichen Datenstrukturen und Funktionen. Wenn diese Anpassungen ohne klare Koordination oder Kommunikation erfolgen, keine Versionierung abrufbar ist oder Code-Review-Prozesse fehlen, können Abhängigkeiten entstehen, die den Beteiligten nicht bewusst sind. Diese Abhängigkeiten bleiben dann intransparent, bis sie durch einen Fehler oder ein Problem offensichtlich werden.

e) Verwendung von dynamischen und indirekten Aufrufen richtig regeln

In ABAP besteht die Möglichkeit, dynamische Programmaufrufe und indirekte Zugriffe zu verwenden, um generische Lösungen zu implementieren (z. B. dynamische Funktionsaufrufe oder SELECTs auf Tabellen, deren Namen erst zur Laufzeit bestimmt werden). Auch werden zum Teil Metadaten oder Tabellen zur Laufzeit genutzt, um Programmabläufe zu steuern. Solche Techniken können nützlich sein, um flexible Lösungen zu entwickeln, aber sie machen den Code weniger nachvollziehbar. Ohne klare Referenzen zu den abhängigen Modulen wird es schwieriger, nachzuvollziehen, welche Programme oder Datenstrukturen tatsächlich verwendet werden.

f) Enge Kopplung zwischen benutzerdefinierten und Standard-SAP-Komponenten beachten

„User Exits“, „Enhancements“ oder „Modifikationen“, um den SAP-Standard zu erweitern. sind Gang und Gäbe. Oft werden diese benutzerdefinierte Entwicklungen (Z-Programme, Erweiterungen) stark mit dem SAP-Standard verknüpft. Wenn Änderungen am Standard vorgenommen werden (z. B. durch ein SAP-Upgrade oder ein Support Package), können unvorhergesehene Abhängigkeiten entstehen, da die Programme eng verzahnt wurden, die nicht transparent sind. Die engen Verbindungen zwischen benutzerdefinierten Erweiterungen und dem SAP-Standard können schwer nachvollziehbar sein.

g) Tests und Qualitätskontrollen nicht vernachlässigen

Wenn der Code nicht ausreichend getestet oder überprüft wird, können Abhängigkeiten übersehen werden. Tests, insbesondere Unit- und Integrationstests, decken oft versteckte Abhängigkeiten auf, die durch Änderungen in einem Modul oder Programm verursacht werden. Wenn solche Tests nicht stattfinden oder unzureichend sind, bleiben diese Abhängigkeiten lange unerkannt und Änderungen mit Fehlern in die Produktion gebracht. Dieser Aspekt ist also einem Mangel an Qualitätssicherungsprozessen geschuldet.

3. Tool-Unterstützung: Automatisierte Transparenz im ABAP-Coding

Die Herausforderungen mit ABAP-Coding sind, wie oben beschrieben, vielseitig und bedeuten eine Menge Aufwand in Bezug auf Dokumentation, Abstimmung und Qualitätssicherung. SAP AddOn-Tools können diese Prozesse automatisieren: Sie dokumentieren, können den Code schnell durchsuchen und anpassen, erleichtern Tests und bieten Kollaborationsfunktionen für interne wie externe Beteiligte.

Um sich den Einsatz solcher Tools im Arbeitsalltag nun konkreter vorstellen zu können, hilft ein konkreter Use Case:

Sie sind ABAP-Entwickler. Seit einiger Zeit wundern Sie sich, warum für den Buchungskreis 2000 in der Tabelle ACDOCA der Record Type immer auf Plan steht. Leider haben Sie keinen Zugriff mehr auf die ursprünglichen Entwickler, die diese Prozesse implementiert haben, weil diese das Unternehmen längst verlassen haben. Sie stehen also vor der Herausforderung, die Herkunft der Daten in dieser Tabelle ohne Tipps oder Dokumentationen zu ermitteln.

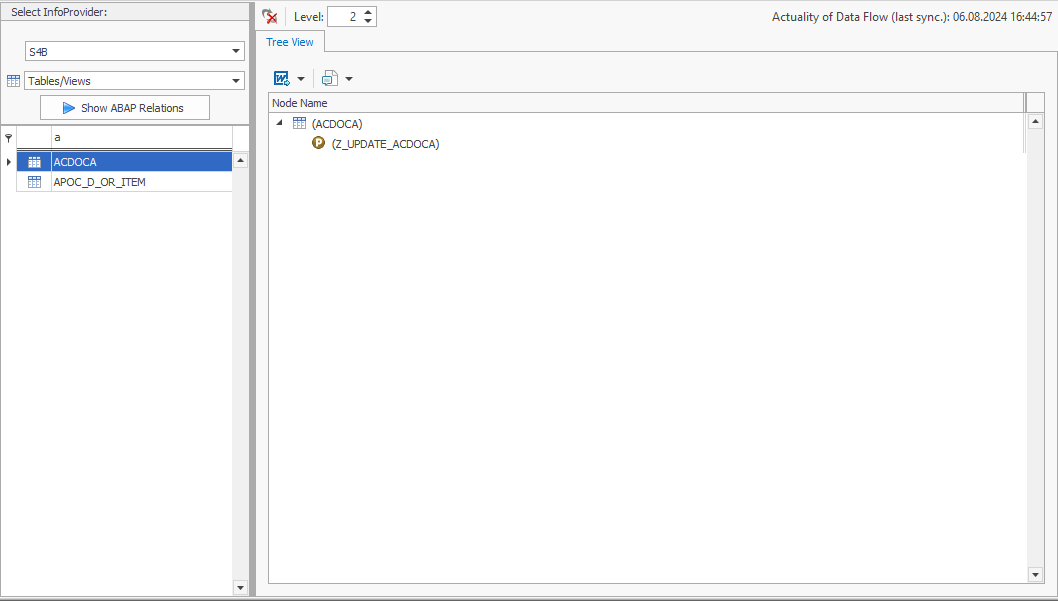

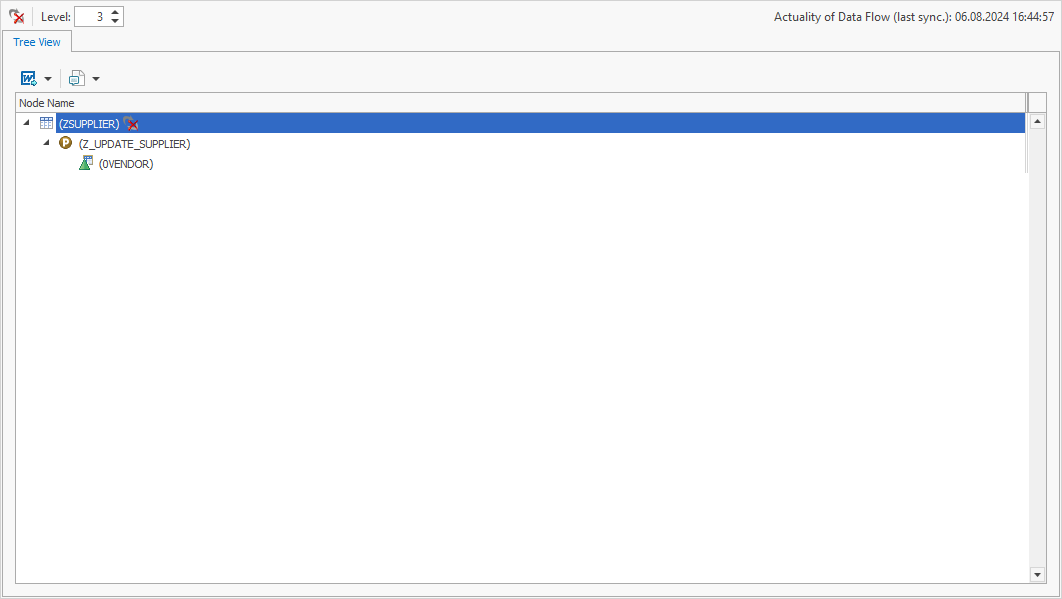

Statt sich mühsam durch das SAP BW-Backend zu kämpfen und manuell nach den relevanten ABAP-Objekten zu suchen, nutzen Sie ein SAP AddOn-Tool, das Metadaten automatisch durchsuchen und in Zusammenhang stellen kann. Ein solches Tool ist zum Beispiel unsere Software “System Scout”. Über seine Funktion „ABAP Relations“ können Sie Beziehungen zwischen verschiedenen ABAP-Objekten und der Tabelle ACDOCA auf Knopfdruck analysieren. So entdecken Sie, dass das Programm Z_UPDATE_ACDOCA die Tabelle ACDOCA manipuliert.

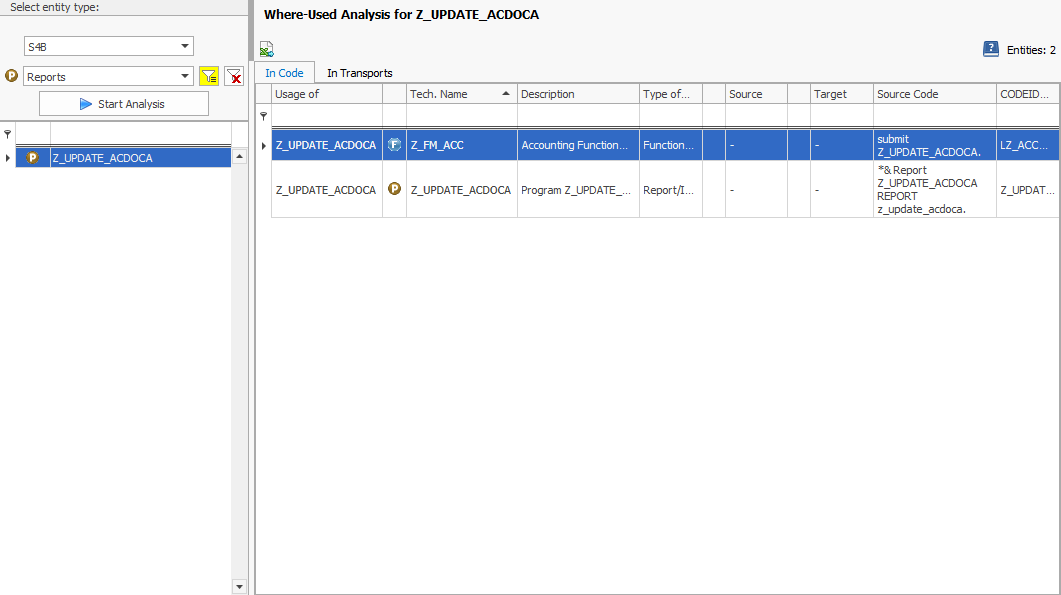

INSERT, MODIFY, UPDATEund DELETE Sie brauchen aber noch mehr Informationen: Ihnen ist es wichtig, zu wissen, welche ABAP-Objekte die Datenmanipulation auslösen. Auch hier bietet das Tool eine hilfreiche Funktion: Den Verwendungsnachweis. Er führt diese Analyse für das Programm Z_UPDATE_ACDOCA durch und findet heraus, dass dieses Programm im Funktionsbaustein Z_FM_ACC referenziert wird:

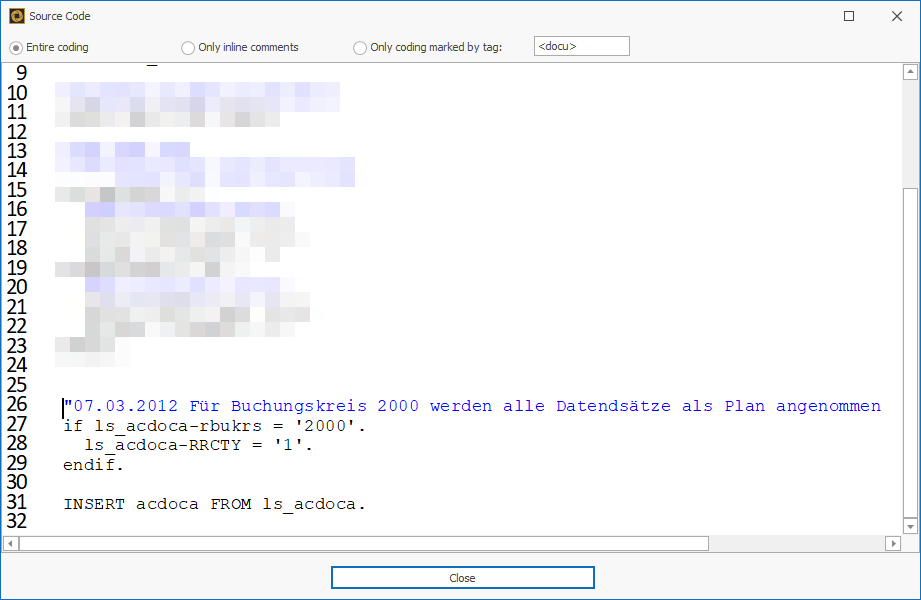

Der Hinweis darüber, wo Sie nach der Logik suchen sollen, die für den Record Type Plan verantwortlich ist, spart Ihnen bei fehlender Dokumentation und einer vollen To Do-Liste wertvolle Zeit.

Nach der automatisierten Analyse des Quellcodes finden Sie außerdem heraus, dass eine sehr alte Logik aus 2012 den Record Type für den Buchungskreis 2000 immer auf Plan setzt.

Übrigens: Abgesehen vom aufgeführten Use Case im klassischen ABAP-Umfeld unterstützt Sie die Funktion „ABAP Relations“ auch im BW-Umfeld. Wird in einem BW-Datenfluss ein Lookup-Scan durchgeführt, können die identifizierten Objekte anschließend nämlich ebenfalls mit „ABAP Relations“ analysiert werden:

So erkennt man beispielsweise, dass die Tabelle ZSUPPLIER von einem Programm – nämlich Z_UPDATE_SUPPLIER – manipuliert wird:

Zusätzlich werden identifizierte Tabellen von BW-Objekten direkt als BW-Objekte angezeigt. Das sorgt für ein besseres Verständnis und ermöglicht weitere Interaktionen und Analysen.

Die Funktionen des Tools System Scouts, hier insbesondere „ABAP Relations“ und der Verwendungsnachweis, bieten ABAP-Entwicklern, die komplexe Datenflüsse schnell nachvollziehen müssen, erhebliche Vorteile:

-

Sie ermöglichen einen schnellen Überblick über Datenmanipulationen und deren Herkunft, sparen Zeit und erhöhen die Genauigkeit der Analysen.

-

Durch die klare Darstellung der Beziehungen zwischen verschiedenen ABAP-Objekten und Tabellen schaffen diese Funktionen Transparenz und erleichtern die Arbeit erheblich.

-

Zudem wird durch die Unterstützung im BW-Umfeld die gesamte Datenflussanalyse in SAP-Systemen noch effizienter und verständlicher.

P.S.: Niemand bleibt ewig auf seinem Posten – vergessen Sie für Ihre Nachwelt also nicht, ABAP-Objekte und deren Beziehungen zu dokumentieren. Auch dafür gibt es ein SAP AddOn-Tool, das automtisiert handelt – den Docu Performer. Er stellt sicher, dass zukünftige ABAP-Entwickler nicht mehr recherchieren müssen, sondern direkt auf detaillierte und tagesaktuelle Dokumentationen zugreifen können.

Kollaboration ist ein entscheidender Erfolgsfaktor, insbesondere in komplexen Bereichen wie der Business Intelligence (BI) eines Unternehmens. Wo Wissen und Skills von Mitarbeitenden vereint werden, kann Großes entstehen – und vieles geht effizienter von statten. Durch Kollaboration kann das BI-Team schneller auf Veränderungen reagieren, flexibler handeln und letztlich das Ergebnis und die Wettbewerbsfähigkeit des Unternehmens positiv beeinflussen.

Da Verantwortlichkeiten und Entscheidungen im BI-Bereich fast ausschließlich Diagramme und Berichte betreffen, setzt Collaborative BI vor allem dort an. Die Ausgangslage: Die meisten Unternehmen setzen High-End-Softwarelösungen für Reports ein, haben jedoch mit einer geringen Nutzung und Akzeptanz in ihren Teams zu kämpfen. Der Collaborative BI-Ansatz steigert die Akzeptanz von BI-Software und verändert gleichzeitig die Art und Weise, wie wir mit Datenanalysen und Entscheidungsfindung umgehen – indem wir die Teamarbeit fördern und das Wissen aller Beteiligten zusammenführen. Im Folgenden wird beleuchtet, wie das aussehen kann.

1. Collaborative BI verstehen

Um ein tieferes Verständnis von Collaborative BI zu bekommen, werfen wir zunächst einen Blick auf die „traditionelle“ Business Intelligence, also vor Einsetzen dieses Trends. Traditionelle Business Intelligence folgt einem zentralisierten, IT-gesteuerten Modell, bei dem ein spezialisiertes Team von Analyst:innen statische, historische Berichte für Entscheidungsträger erstellt. Die Fertigstellung der Berichte kann sich gut und gerne mal etwas verzögern, denn Informationen müssen zusammengesucht und Abhängigkeiten berücksichtigt werden.

Collaborative BI hingegen ermöglicht einer größeren Anzahl von Benutzern im gesamten Unternehmen die Interaktion mit dynamischen Echtzeitdaten mit Hilfe von Self Service-Tools, die die Abhängigkeit von der IT verringern. Diese Methode und die dazugehörigen Tools fördern eine bessere Zusammenarbeit durch Funktionen wie die gemeinsame Nutzung von Berichten, Kommentaren und Anmerkungen und legen gleichzeitig den Schwerpunkt auf Echtzeit- und prädiktive Analysen, um eine proaktive Entscheidungsfindung zu erleichtern.

Traditionelle BI versus Collaborative BI

Ziele bei der Implementierung von Collaborative BI

Die Hauptintention von Collaborative BI ist die Verbesserung von Problemlösungs- und Entscheidungsprozessen: Man will handlungsfähiger werden. Die folgenden Aspekte sind für das Erreichen dieses übergeordneten Ziels von grundlegender Bedeutung:

Dezentralisierte Analysen

Der Punkt mag nach dem, was wir bisher über Collaborative BI gehört haben, paradox klingen, bezieht sich jedoch eher auf den Aspekt des Schwarmwissens: Durch die Einbindung und Befähigung einer Vielzahl von Benutzern mit unterschiedlichen Rollen, Hintergründen und Fähigkeiten können Unternehmen auch reichere Perspektiven einnehmen. Dieser Ansatz trägt dazu bei, Bottle Necks zu vermeiden, die traditionell mit zentralisierten BI-Teams verbunden sind, und beschleunigt so den Problemlösungsprozess.

Optimiertes Dashboard- & Berichtsdesign

Benutzer mit unterschiedlichen Rollen, Hintergründen und Qualifikationsniveaus benötigen indivuelle Dashboards und Berichte, die auf ihre spezifischen Bedürfnisse abgestimmt sind. Durch die Förderung des Ideen- und Wissensaustauschs zwischen diesen Nutzern, beispielsweise über Kommentarfunktionen, können Unternehmen maßgeschneiderte Dashboards und Berichte erstellen, die den unterschiedlichen Anforderungen ihrer Zielgruppe gerecht werden. Darüber hinaus ermöglicht der Aspekt des Echtzeitzugriffs auf Daten den Usern, Probleme schneller zu erkennen und zu lösen. Interaktive Dashboards und Berichte, die beispielsweise Absprünge erlauben, ermöglichen es Usern darüber hinaus, die Daten tiefer zu durchdringen und Ursachen und Muster schneller aufzudecken als bei statischen Berichten.

Kollaborative Tools

Kollaborative BI-Tools bieten die genannten Funktionen wie Kommentare, Freigaben und Diskussionsstränge, die die unmittelbare Kommunikation und Zusammenarbeit zwischen den Teammitgliedern erleichtern und einen schnelleren Konsens und schnelleres Handeln ermöglichen. Der nahtlose Datenaustausch in Echtzeit im gesamten Unternehmen stellt sicher, dass alle relevanten Interessengruppen auf dieselben Informationen zugreifen können, und fördert so einen einheitlichen Ansatz für die Entscheidungsfindung. Mit Self-Service-BI-Tools können Benutzer ihre eigenen Berichte und Abfragen erstellen, ohne auf die Unterstützung der IT-Abteilung warten zu müssen, was den Entscheidungsprozess beschleunigt.

2. Herausforderungen bei der Implementierung von Collaborative BI

Wie jede neue Implementierung bringt natürlich auch Collaborative BI eine Reihe von Herausforderungen mit sich, die je nach Ausgangsposition des Unternehmens und den aktuellen Umständen unterschiedlich sein können. Die Bewältigung dieser Herausforderungen wird den Erfolg Ihrer Collaborative BI-Implementierung sicherstellen.

- Tool-Elastiziät

- Datenschutz, Sicherheit und Data Ownership

- Metadaten

- Daten-Integration

- Kommunikation zwischen Mitarbeitern

Tool-Elastizität

Die Elastizität von BI-Tools, d.h. die Fähigkeit zur Skalierung und Anpassung an wechselnde Benutzerbedürfnisse, stellt auch bei der Implementierung von Collaborative BI eine Herausforderung dar: Die Gewährleistung der Skalierbarkeit ohne Performance-Einbußen, die Integration in bestehende Systeme, die Verwaltung variabler Kosten und die Erleichterung der Benutzerakzeptanz auf allen Qualifikationsniveaus erfordern einige Anstrengungen. Darüber hinaus erschweren mitunter Bedenken zur Datensicherheit, insbesondere bei Cloud-basierten Lösungen, die Performance-Optimierung, die Aufrechterhaltung eines konsistenten und zuverlässigen Zugriffs und der Ausgleich zwischen Anpassung und Stabilität den Prozess. Diese Faktoren machen es für Unternehmen schwierig, elastische BI-Tools für die Zusammenarbeit effektiv zu implementieren und zu pflegen.

Datenschutz, Sicherheit & Data Ownership

Datenschutz, Sicherheit und Data Ownership stellen bei der Implementierung von Collaborative BI natürlich eine Herausforderung dar: Der Umgang mit sensiblen Informationen, die Verwaltung der authorisierten Nutzerzugriffe, die Einhaltung von Vorschriften und die Bewältigung des erhöhten Risikos von Datenschutzverletzungen sind komplex – und entscheidend für das Bestehen eines Tools. Darüber hinaus erfordert die Implementierung dieser robusten Sicherheitsmaßnahmen nicht gerade wenig Budget und Know-How. Kontinuierliche User-Schulungen sind unerlässlich, um menschliche Fehler zu minimieren, die die Datensicherheit gefährden könnten.

Metadaten

Metadaten sind im Zusammenhang mit Collaborative BI sehr wichtig, da sie die Fragen nach der Herkunft und Verwendung der Daten beantworten. In der traditionellen BI werden diese Fragen von den Fachabteilungen gestellt und von der IT beantwortet. In der Collaborative BI finden die Business User diese Antworten selbstständig. Dies stellt jedoch die Herausforderung dar, sicherzustellen, dass die Daten auch von weniger technisch-versierten Usern richtig verstanden und im gesamten Unternehmen genutzt werden können – z.B. durch eine unkomplizierte Darstellung und über Schulungen. Darüber hinaus sind Metadaten nur dann für korrekte Analysen von Nutzen, wenn sie aktuell gehalten werden – dies erfordert einen erheblichen Aufwand und eine ständige Dokumentation von beispielsweise Data Sources, Definitionen, Data Lineage und Verwendung. Fehler in den Metadaten können zu Fehlinterpretationen führen, was die gemeinsame Nutzung von Daten und die Zusammenarbeit erschwert.

Datenintegration

Die Datenintegration ist eine besondere Herausforderung und entscheidend für Collaborative BI: Es geht darum, verschiedene Datenquellen mit unterschiedlichen Formaten, Strukturen und Qualitätsstufen in ein einheitliches System zu konsolidieren, auf das alle Benutzer zugreifen und es analysieren können. Sie ist unerlässlich, um eine kollaborative Entscheidungsfindung in Echtzeit zu ermöglichen, erfordert jedoch ausgefeilte Tools und Prozesse für die Extraktion, Transformation und das Laden von Daten. Eine effektive Datenintegration erfordert auch die Zusammenarbeit zwischen der IT-Abteilung und den Fachbereichen, um die Datendefinitionen und -standards abzustimmen — eine komplexe, aber wichtige Aufgabe, um sicherzustellen, dass alle Benutzer mit denselben Daten und mit den korrekten Daten arbeiten.

Kommunikation zwischen Mitarbeitenden

Die Kommunikation zwischen Mitarbeitenden ist natürlich der Kern der ganzen Angelegenheit – und stellt auch eine eigene Herausforderung dar: Aufgrund der unterschiedlichen (technischen und geschäftlichen) Fachkenntnisse und des unterschiedlichen Verständnisses von Daten, der unterschiedlichen Sprache, Prioritäten und Perspektiven sind Missverständnisse vorprogrammiert. Sie können zu falschen Dateninterpretationen, fehlerhaften Analysen und schlechten Entscheidungen führen. Es muss fortwährend dafür gesorgt werden, dass alle Beteiligten bei den BI-Zielen, -Prozessen und der -Toolakzeptanz dieselbe Linie fahren. Die Implementierung dieser Kanäle und die Förderung einer Kultur der offenen Kommunikation erfordern ein ständiges Engagement der Führungsebene, um Silos aufzubrechen und die aktive Beteiligung aller Mitarbeiter zu fördern.

3. Empfehlungen zur Integration von Collaborative BI in Ihre bestehende BI-Landschaft

Collaborative BI mag seine Herausforderungen mit sich bringen, aber mit den folgenden Empfehlungen werden Sie diese hoffentlich überwinden – mehr sogar, von den Vorteilen profitieren:

- Self-Service Datenvisualisierung

- Datenqualität Data Governance

- Metadaten-Management Data Cataloging

- Unternehmenskultur Kommunikation

Self-Service & Datenvisualisierung

Self-Service und Datenvisualisierung sind, wie bereits angeführt, Schlüsselfaktoren, wenn es um Collaborative BI geht – beide Aspekte entlasten die IT-Abteilung und machen Daten für alle Abteilungen zugänglich und verständlich. Dazu braucht es:

- intuitive, benutzerfreundliche Tools, die Mitarbeitende aller Kenntnisniveaus befähigen…

- …selbständig auf Daten zuzugreifen, sie zu analysieren und zu visualisieren und so eine datenorientierte Kultur im gesamten Unternehmen zu fördern,

- umfassenden Schulungen, um die Nutzungsrate und Effizienz dieser Tools sicherzustellen

- Customizability – so wird es Usern möglich, Dashboards auf ihre speziellen Bedürfnisse zuzuschneiden und Ergebnisse einfacher mit Kollegen zu teilen,

- starke Data Governance und Echtzeit-Datenzugrif – so wird die Zuverlässigkeit und Relevanz der gewonnenen Erkenntnisse gewährleistet.

Die aktive Ermunterung zu Feedback und die kontinuierliche Verbesserung der Tools auf Basis dieser Benutzererfahrungen – und das kontinuierlich, denn Bedürfnisse entwickeln sich weiter.

Datenqualität & Data Governance

Eine zweite wichtige Voraussetzung für die Einführung von Collaborative BI ist die Verbesserung der Datenqualität. Dies kann durch die Einführung starker Data Governance-Regularien erreicht werden:

Dazu zählen

- standardisierte Dateneingabeprotokolle,

- regelmäßige Datenbereinigung

- Validierungsverfahren

- und klares Data Ownership, um die Verantwortlichkeiten aller Beteiligten zu klären

So kann eine hochwertige Datenqualität gewährleistet werden.

Moderne Datenmanagement-Tools automatisieren sogar die Fehlererkennung und -korrektur und reduzieren Inkonsistenzen damit erheblich. Grundsätzlich fördert auch die Kultur der Transparenz im Kontext von Collaborative BI eine offene Kommunikation über Daten-bezogene Probleme und gemeinsame Lösungsbemühungen, selbst wenn dies manuell geschieht.

Metadaten-Management & Datenkatalogisierung

Schließlich sind die Verwaltung von Metadaten und die Katalogisierung von Daten ein wesentlicher Aspekt, um den Zielzustand von Collaborative BI zu erreichen. Im Idealfall können Sie sogar beides miteinander kombinieren: Über APIs oder spezielle Metadaten-Repositories ist es möglich, SAP- oder Power BI-Metadaten in Ihren Datenkatalog zu integrieren oder daneben aufzubauen.

Wenn Sie einen Datenkatalog in Ihrem Unternehmen implementieren, sollte sichergestellt werden, dass dieser

- jedem Mitarbeitenden zentral zugänglich ist (z.B. als Webapplikation),

- eine intuitive Benutzeroberfläche bietet und (Meta-)Daten einfach verständlich darstellt, so dass Benutzer unterschiedlicher Fachhintergründe in der Lage sind, die Informationen zu verstehen,

- Metadaten wie die Herkunft, die Verwendung und den Aufbau von Daten enthält, um auftretende Reporting-Fragen effizient und an Ort und Stelle beantworten zu können,

- aktuelle (Meta-)daten anzeigt, um dem Titel „Single Point of Truth“ auch gerecht zu werden – denn veraltete Daten sind für die User irrelevant und entziehen dem Katalog seine Relevanz

Kontinuierliche Schulungen und Unterstützung der Mitarbeiter in Bezug auf die Bedeutung und Verwendung von Metadaten tragen dazu bei, dass die Metadaten im Sinne der Collaborative BI dazu beitragen können, effizientere und fundiertere Entscheidungen zu treffen.

Unternehmenskultur & Kommunikation

Nicht zuletzt sind es die Menschen, die ein Unternehmen ausmachen. Um die neue Kultur der Zusammenarbeit zu fördern, sollte das Management:

- auf allen Ebenen des Unternehmens auf Transparenz setzen und aktiv den Austausch von Informationen und Erkenntnissen fördern,

- regelmäßige Schulungen und Workshops durchführen, um die Datenkompetenz zu verbessern und sicherzustellen, dass alle Mitarbeitenden sich in ihrer Fähigkeit, zu BI-Initiativen beizutragen, sicher fühlen,

- Teamarbeit und gemeinsame Problemlösungen anerkennen und belohnen

- darüber hinaus sollt physisch Raum für Kollaboration geschaffen werden – an dezidierten Räumen zum Austausch im BI-Bereich sollte es nicht mangeln

4. Collaborative BI-Tools: Data Catalog trifft Metadaten-Repository

Wie im Artikel beschrieben, sind benutzerfreundliche Datenkataloge und Metadaten-Repositories zwei entscheidende Werkzeuge zur Umsetzung von Collaborative BI in Ihrem Unternehmen. Mit 16 Jahren Erfahrung in der BI Softwareentwicklung hat bluetelligence ein Tool entwickelt, das beides vereint: Unser Datenkatalog „Enterprise Glossary“ enthält sowohl Businessinformationen (Kennzahlen und Berichte) als auch die dazugehörigen Metadaten über angeschlossene SAP- und Power BI-Systeme. Er bietet ideale Voraussetzungen, um Collaborative BI umzusetzen durch:

- einen zentralen Zugang zu allen Kennzahlen und Berichten im Unternehmen über den Webbrowser sowie den direkten Absprung dazu

- verständlich aufbereitete Informationen, die technisch- und weniger technich Versierte verstehen können: fachliche Definitionen und Berechnungen sowie dazugehgörige technische Metadaten (Datenquelle, Datenherkunft, abhängige Kennzahlen usw.

- eine benutzerfreundliche Suche und eine intuitiven Oberfläche

- die automatische Synchronisierung aller verbundenen SAP- und Power BI-Systeme für stets aktuelle Informationen

- die Bereitstellung von Kommunikationsfunktionen für Kommentare und Diskussionen

- die Möglichkeit, Standardvorlagen zu verwenden oder die Glossareinträge vollständig an Ihre Bedürfnisse anzupassen

Glossareintrag im Data Catalog „Enterprise Glossary“

Data Lineage im Data Catalog „Enterprise Glossary“

Unser Data Catalog empowert damit Ihre Fachanwender, entlastet die IT und optimiert Daten-bezogene Prozesse und Kommunikation. Mehr Details zum Enterprise Glossary finden Sie auf www.enterprise-glossary.de.

Wenn Sie bereits einen Datenkatalog verwenden, darüber hinaus aber SAP- oder Power BI-Metadaten einbeziehen möchten, kann unsere API Sie dabei unterstützen. Mehr Infos zur API finden Sie auf www.bluetelligence.de/metadata-api.

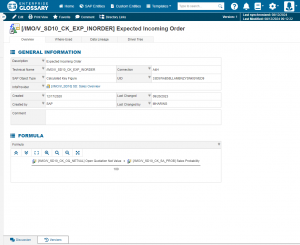

Als BI Self-Service-Anbieter und Softwareentwickler im Bereich SAP Business & Analytics begegnen uns immer wieder „Zeitfresser“, also Prozesse aus dem Business Intelligence-Alltag, die sich wesentlich schneller lösen lassen würden. Dieser Beitrag behandelt die Abhängigkeit zwischen Fachbereichen, die mit Dashboards und Berichten arbeiten, und der IT, die ihrerseits Tickets bearbeitet, wenn es genau dort hakt. Er erörtert das Konzept BI-Self Service, das helfen kann, diese Prozesse zu beschleunigen und so Kosten, Zeit und Nerven zu sparen. Konkret geht es darum, Fachbereichen mithilfe von Data Cataloging Einblicke in die Metadaten ihrer Kennzahlen und Berichte zu gewähren – so wird die IT entlastet und das Business effizienter und handlungsfähiger.

Der Use Case: Meist ein Anzeigefehler im SAP-Dashboard

Man kennt’s: Dashboards (zum Beispiel SAC-Dashboards oder SAP Business Objects Dashboards) sollen Business Departments wie dem Controlling, Vertrieb, Supply Chain Management etc. eigentlich Überblick und Klarheit bringen – wenn sie dann aber falsche Werte oder Fehlermeldungen anzeigen, ist natürlich das Gegenteil der Fall. Ärgerlich ist das insbesondere, wenn das dem Fachbereich kurz vor einem Meeting auffällt, in dem das Dashboard gebraucht wird.

Häufig liegt der Fehler bei einer der verwendeten Kennzahlen im SAP-System – insbesondere, wenn diese sich aus mehreren weiteren Kennzahlen im System zusammensetzt, also eine „verschachtelte Kennzahl“ ist. Eine andere Bezeichnung, die häufig verwendet wird, ist die „berechnete Kennzahl“.

Verschachtelte Kennzahlen haben ihre Tücken

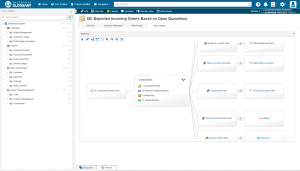

Ein Beispiel aus dem Vertrieb: Die Kennzahl „Erwarteter Auftragseingang“ in einem Sales-Dashboard kann sich nämlich zum Beispiel aus vier bis sechs weiteren, ebenfalls verschachtelten Kennzahlen zusammensetzen- zum Beispiel aus der Verkaufswahrscheinlichkeit, den offenen Angeboten, und so weiter.

Herauszufinden, ob im SAP-System bei einer dieser vielen verwendeten Kennzahlen ein Fehler vorliegt, frisst verdammt viel Zeit.

Was genau hier so lange dauert? Solange der Fachbereich nur den Fehler im Dashboard feststellt, nicht aber einsehen kann, welche weiteren „Unter“-Kennzahlen die falsch angezeigte Kennzahl beinhaltet, kann er nur ein unspezifisches Support-Ticket bei der IT aufgeben. Diese muss dann auf Fehlersuche gehen und alles im Backend der Kennzahl im SAP-System beleuchten. Und da die IT bekanntlich nur so in Tickets schwimmt, wird das Problem noch eine Weile bestehen.

Wie versprochen geht es in diesem Artikel natürlich nicht nur um Probleme, sondern auch um Lösungen – und die Lösung in diesem Fall lautet BI Self-Service – genauer, Data Catalog. Und Treiberbaum. Aber von vorne:

Die Lösung: SAP-Metadaten im Data Catalog

Um Fachbereichen gleichermaßen Einblicke zu geben und der IT Arbeit abzunehmen, empfiehlt sich der Einsatz eines Data Catalogs, der auch den Durchblick bei SAP-Metadaten bietet – zumindest so aufbereitet, dass Fachbereiche die Inhalte einfach verständlich konsumieren können.

Unser Data Catalog, das Enterprise Glossary erstellt für jede Kennzahl der angeschlossenen SAP-Systeme automatisch Glossareinträge, in denen sowohl die fachliche Definition als auch ihre Berechnung mit allen involvierten Kennzahlen abgebildet ist. Mit der neuesten Enterprise Glossary-Funktion, dem „Treiberbaum“, wird die Formel sogar grafisch in einer Netzwerkgrafik dargestellt und bietet so eine einfach verständliche Übersicht über sämtliche Level der verschachtelten Kennzahl (siehe GIF).

So kann von Fachbereichen ohne Zugang zu SAP sofort nachvollzogen werden, welche Kennzahlen am Dashboard beteiligt sind. Wenn aus fachlicher Sicht schon hier eine falsche Berechnung vermutet wird, kann die IT viel gezielter – und wesentlich schneller – das Problem im Backend beheben. Der Data Catalog fungiert so als Bindeglied zwischen Fachbereichen und IT – und macht allen das Leben ein bisschen leichter. Neben der steigenden Mitarbeiterzufriedenheit sind für Budgetverantwortliche natürlich vor allem Kosten ein wichtiger Aspekt: Durch die eingesparte Zeit kann das Enterprise Glossary als BI Self-Service Tool mindestens 40.000€ im Jahr einsparen. Wie die Kostenersparnis anhand des aufgeführten Use Case mit Fehlern im Dashboard genau zustande kommt, sehen Sie in diesem Video:

Sie sehen gerade einen Platzhalterinhalt von YouTube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr Informationen

Fazit: Der Einsatz eines Datenkatalogs mit Anknüpfung an verwendete SAP-Systeme schafft einen BI Self Service-Point, der eine effizientere Zusammenarbeit zwischen Fachbereichen und der IT erlaubt – sei es bei Fehlersuchen in Dashboards, der Definition von Kennzahlen oder bei Fragen zu bereits bestehenden Berichten – zum Beispiel, welche Berichte bereits existieren, welche Datenquelle sie haben oder welche Kennzahlen Bestandteil der Query sind.

Plastikmüll in den Weltmeeren ist ein Riesenproblem. Mit seinem Ocean Cleanup Project hat es sich der junge Niederländer Boyan Slat zur Aufgabe gemacht, dieses Problem aktiv anzugehen. Wir sind beeindruckt von seiner Entschlossenheit und Innovationskraft und unterstützen das Projekt seit letztem Jahr. Höchste Zeit also, davon zu erzählen.

Fünf Billionen Plastikteile treiben zurzeit im Ozean. Wie auch immer sich diese Zahl überhaupt beziffern lässt, sie klingt beängstigend. Längst wissen wir: Langfristig zerfallen die Plastikstücke zu Mikroplastik und richten fatale Schäden in unserem Ökosystem an. Neben den Meeresbewohnern ist auch der Mensch im Laufe der Nahrungskette betroffen.

Es bleibt die Frage, was dagegen zu tun ist. Jedes Stück einzeln einzusammeln und abzutransportieren, wäre weder bezahlbar noch zeitlich zu schaffen. Die Meere einfach aufzugeben ist für viele aber – zum Glück – keine Option.

Der Niederländer Boyan Slat hat beschlossen, sich nicht hilflos geschlagen zu geben und stattdessen zu handeln. Er fasste diesen Entschluss im Alter von nur 17 Jahren. Zwei Jahre später, 2013, gründete er das Ocean Cleanup Project. Mit einem Team von mittlerweile bis zu 100 Forschern und Ingenieuren hat er immer weiter getüftelt und so ein geniales System entwickelt.

Die zielführende Technologie beruht im Wesentlichen auf U-förmig angeordneten Plastikschläuchen. Durch Gewichte am Meeresboden gehalten, treiben diese Schläuche an der Meeresoberfläche und bündeln den Müll mithilfe der natürlichen Meeresströme in der Mitte, wo er nach einiger Zeit abgeschöpft werden kann. Das Meer sammelt seinen Müll also quasi selbst zusammen.

Sie sehen gerade einen Platzhalterinhalt von YouTube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.